Najnowsza aktualizacja Windsurf, agentycznego środowiska programistycznego (IDE), wprowadza funkcję optymalizacji kosztów oraz poprawkę błędu, który utrudniał pracę części użytkowników. Główną nowością jest inteligentny router modeli. System ten automatycznie wybiera model AI najlepiej dopasowany do konkretnego zadania, co ma zapobiegać zbyt szybkiemu zużywaniu miesięcznego limitu tokenów. Producent naprawił również usterkę blokującą zmianę modelu po wysłaniu pierwszego zapytania i zwrócił wykorzystane limity osobom, które miały z tym problem.

Zmiany te są reakcją na uwagi społeczności dotyczące tempa wyczerpywania się pakietów po modyfikacji systemu rozliczeń. Windsurf rywalizuje bezpośrednio z Cursorem i skupia się na poprawie wydajności oraz kontroli wydatków podczas pracy w trybie „vibe codingu”.

Jak działa inteligentny router modeli?

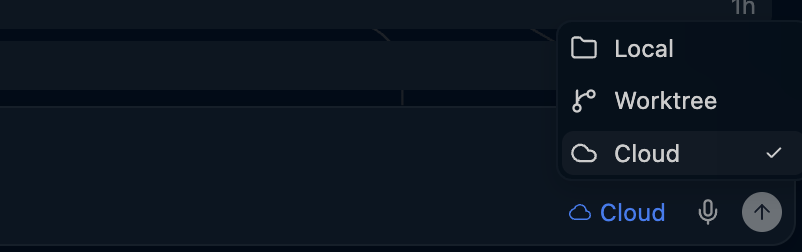

Inteligentny router modeli to nowa pozycja na liście wyboru modeli. System dynamicznie dobiera odpowiedni model bazowy (taki jak GPT, Claude czy Gemini) do każdego zapytania programistycznego. Najważniejszą cechą tego rozwiązania jest rozliczanie zużycia według stałej stawki za token, bez względu na to, który model premium zostanie faktycznie uruchomiony w tle.

Mechanizm ten kieruje proste zadania do lżejszych i tańszych modeli, rezerwując zaawansowane jednostki dla trudniejszych problemów. Dzięki temu przydzielona pula tokenów ma wystarczać na dłuższy czas. Z funkcji mogą korzystać użytkownicy indywidualni posiadający plany Pro, Max oraz Teams.

Przez najbliższe dwa tygodnie obowiązują promocyjne ceny za dodatkowe użycie: 0,50 USD za 1 milion tokenów wejściowych, 2,00 USD za 1 milion tokenów wyjściowych oraz 0,10 USD za 1 milion tokenów odczytu z pamięci podręcznej (cache).

Przejrzyste koszty i poprawki techniczne

Aktualizacja zmienia wygląd selektora modeli, aby ułatwić sprawdzanie kosztów. Teraz stawki za tokeny wejściowe, wyjściowe i odczyt z cache są widoczne bezpośrednio przy każdym modelu. Ma to zapewnić użytkownikom lepszy wgląd w to, jak wydawane są ich środki.

Dodatkowo w oknie odpowiedzi pojawia się teraz informacja o dokładnej liczbie zużytych tokenów dla danego zapytania. W oknie kontekstu dodano też licznik czasu wygaśnięcia pamięci podręcznej promptów.

Kluczową poprawką jest usunięcie błędu w routerze, który blokował możliwość przełączenia modelu po rozpoczęciu sesji. Firma ogłosiła, że użytkownicy dotknięci tym problemem otrzymali pełny reset limitów oraz zwrot poniesionych opłat dodatkowych.

Rozwój narzędzia i ekosystemu

Wprowadzenie routera modeli to część strategii Windsurf opartej na zarządzaniu kosztami i rozwijaniu funkcji agentowych. Wcześniej platforma umożliwiła integrację z Devin Cloud, co pozwala na delegowanie zadań do agenta AI działającego w chmurze.

Windsurf, rozwijany przez Cognition AI, rozbudowuje także wsparcie dla Model Context Protocol (MCP). Poprawiono między innymi zarządzanie zasobami, widoczność stanu ładowania oraz stabilność połączeń przy inicjalizacji. Ulepszenia te mają znaczenie dla osób korzystających z rozbudowanych procesów deweloperskich i zewnętrznych narzędzi.

Skuteczność nowego routera zależy od tego, jak trafnie system będzie dobierał modele, by oszczędności nie odbywały się kosztem jakości kodu. Jeśli mechanizm będzie działał sprawnie, może stać się standardowym sposobem korzystania z aplikacji dla osób, które chcą lepiej wykorzystać swój abonament.

Dodaj komentarz