OpenAI wydało nową wersję swojego narzędzia dla deweloperów – OpenAI Codex 0.120.0, która koncentruje się na usprawnieniu pracy z agentami w czasie rzeczywistym oraz stabilizacji środowisk deweloperskich, zwłaszcza na Windows. Aktualizacja, opublikowana 11 kwietnia 2026 roku, wprowadza znaczące ulepszenia do systemu Realtime V2, terminalowego interfejsu użytkownika (TUI) oraz rozwiązuje kluczowe problemy związane z politykami systemu plików w sandboxie. To kolejny krok w rozwoju OpenAI Codex jako platformy do programowania agentowego bezpośrednio z terminala.

Głównym celem wydania jest poprawa współpracy między użytkownikiem a wieloma agentami AI. Dzięki nowym mechanizmom kolejkowania i strumieniowania postępu w tle, praca z narzędziem ma być bardziej intuicyjna i mniej podatna na zakłócenia. Zespół skupił się również na solidnych poprawkach dla systemu Windows, który często stwarzał wyzwania dla izolowanych środowisk uruchomieniowych.

Kluczowe zmiany w wydaniu 0.120.0

- Ulepszenia Realtime V2: System może teraz strumieniować postęp agenta działającego w tle, nawet gdy inne zadanie jest jeszcze wykonywane. Odpowiedzi kolejnych agentów są kolejkowane i czekają, aż aktywna odpowiedź się zakończy, co poprawia "przekazywanie pałeczki" w czasie rzeczywistym.

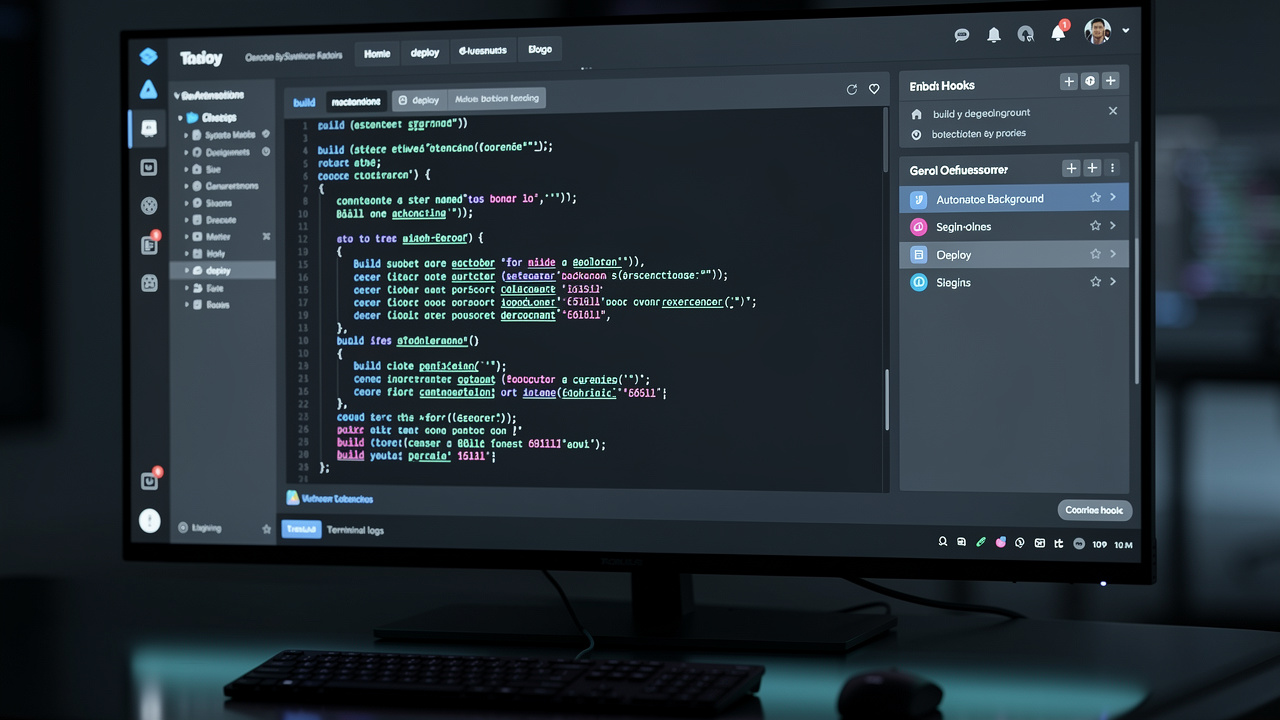

- Lepsze skanowanie hooków w TUI: Interfejs terminalowy został ulepszony, aby aktywność hooków (dodatkowych skryptów) była łatwiejsza do śledzenia. Działające hooki są wyraźnie oddzielone, a ich ukończone dane wyjściowe są zachowywane tylko wtedy, gdy są przydatne.

- Stabilizacja sandboxa Windows: Naprawiono problemy z politykami systemu plików, lepiej obsługiwane są wiele wersji OpenAI Codex zainstalowanych w systemie, a wywołania

Start-Processw tle nie otwierają już niechcianych okien PowerShell. - Niestandardowe linie statusu i MCP: TUI zyskało wsparcie dla niestandardowych linii statusu, w tym opcję graficznego paska zużycia kontekstu. Schematy deklaracji narzędzi w Model Context Protocol (MCP) zostały dopracowane dla czystszej typizacji.

Głębsza integracja agentów w czasie rzeczywistym

Najważniejsza zmiana w tym wydaniu dotyczy rdzenia funkcji Realtime V2. Wcześniej interakcja z wieloma agentami mogła prowadzić do sytuacji, w których odpowiedzi się nakładały lub konkurowały o uwagę użytkownika. Teraz, jak opisano w notkach wydania, "Realtime V2 może strumieniować postęp agenta w tle, gdy praca wciąż jest wykonywana i kolejkować kolejne odpowiedzi, aż aktywna odpowiedź się zakończy".

W praktyce oznacza to, że jeśli poprosisz głównego agenta o zrefaktoryzowanie kodu, a w międzyczasie uruchomisz drugiego agenta do analizy logów, ten drugi będzie cicho zbierał dane i przygotowywał się w tle. Jego postęp może być widoczny (np. jako pasek lub informacja), ale pełna odpowiedź pojawi się dopiero wtedy, gdy pierwsze zadanie dobiegnie końca. To kluczowe dla zachowania kontekstu i płynności rozmowy, co jest istotą efektywnego programowania.

Dopracowanie interfejsu i narzędzi dla dewelopera

Interfejs terminalowy (TUI) otrzymał subtelne, ale znaczące usprawnienia. Lepsza wizualizacja hooków pomaga deweloperom śledzić, które automatyzacje są właśnie uruchomione, a które już się zakończyły, bez zaśmiecania widoku niepotrzebnymi informacjami.

W społeczności szybko zauważono nowe, praktyczne funkcje, takie jak możliwość zmiany nazwy wątku (/rename) czy skopiowania ostatniego outputu agenta za pomocą Ctrl+O. Pojawiła się także opcja włączenia powiadomień TUI oraz, co najciekawsze graficznie, opcjonalny pasek stanu zużycia kontekstu w formie wykresu słupkowego. Te zmiany, choć pozornie kosmetyczne, znacząco podnoszą ergonomię codziennej pracy.

Dopracowano również system MCP, który służy do integracji zewnętrznych narzędzi i serwisów. Czystsze schematy deklaracji narzędzi (outputSchema) ułatwiają precyzyjne definiowanie typów danych, co przekłada się na mniej błędów i lepsze podpowiedzi podczas kodowania z pomocą agentów.

Twardy orzech do zgryzienia: stabilność na Windows

Dla wielu użytkowników, szczególnie w środowiskach korporacyjnych, najważniejszą częścią tego wydania mogą być poprawki związane z sandboxem na Windows. Izolowane środowisko wykonawcze OpenAI Codex miało historycznie problemy ze ścisłymi politykami systemu plików Windows oraz z niechcianym pojawianiem się okien konsoli.

Wersja 0.120.0 rozwiązuje te problemy. Poprawki obejmują lepsze zarządzanie wieloma instalacjami OpenAI Codex w systemie, unikanie narzucania list kontroli dostępu (ACL) w katalogach z zainstalowaną aplikacją oraz, co szczególnie istotne dla płynności pracy, ukrywanie okien PowerShell przy wywołaniach procesów w tle za pomocą Start-Process -WindowStyle Hidden. To nie spektakularna nowa funkcja, ale fundamentalna poprawka, która czyni narzędzie bardziej niezawodnym i profesjonalnym na tej platformie.

Kontekst rozwoju i podsumowanie

Wydanie 0.120.0 wpisuje się w szerszą strategię OpenAI.