Najnowsza aktualizacja OpenCode, otwartoźródłowego narzędzia AI dla programistów, wprowadza zmiany w dwóch obszarach: konfiguracji usług Cloudflare AI oraz obsłudze interfejsu tekstowego (TUI). Zmiany opisane w dokumentacji projektu skupiają się na ułatwieniu pierwszego uruchomienia programu i poprawie wygody pracy w terminalu.

Łatwiejsza konfiguracja Cloudflare Workers AI i AI Gateway

Wprowadzono czytelniejsze komunikaty diagnostyczne dla osób korzystających z Cloudflare Workers AI oraz Cloudflare AI Gateway. System sprawdza teraz obecność zmiennych konfiguracyjnych, takich jak Account ID, Gateway ID czy CLOUDFLARE_AI_GATEWAY_API_KEY. Jeśli ich brakuje, użytkownik widzi konkretną informację o tym, jakie dane musi uzupełnić, zamiast ogólnych błędów systemowych.

Ma to pomóc osobom, które dopiero zaczynają pracę z narzędziem. Cloudflare Workers AI umożliwia korzystanie z modeli językowych przez API bez zakładania kont u wielu różnych dostawców. W OpenCode proces ten można przejść na dwa sposoby: interaktywnie, korzystając z instrukcji (np. przez uwierzytelnienie na opencode.ai/auth), lub wpisując dane bezpośrednio do pliku opencode.json.

Zmiany w interfejsie terminalowym (TUI)

Druga część poprawek dotyczy interfejsu tekstowego. W systemie Windows przywrócono standardowe zachowanie klawiatury, rezygnując z wcześniejszych tymczasowych rozwiązań, które utrudniały wprowadzanie znaków. Dla programistów pracujących głównie w terminalu jest to zmiana poprawiająca płynność pisania.

Użytkownicy zyskali też większą kontrolę nad myszą wewnątrz TUI. Funkcję przechwytywania kursora można teraz wyłączyć w ustawieniach lub za pomocą zmiennej środowiskowej OPENCODE_DISABLE_MOUSE. Dodatkowo poprawiono mechanizm ładowania wtyczek TUI. Teraz poprawnie przypisują się one do konkretnego projektu, nawet gdy użytkownik ma otwartych kilka katalogów jednocześnie.

Poprawki w działaniu systemu

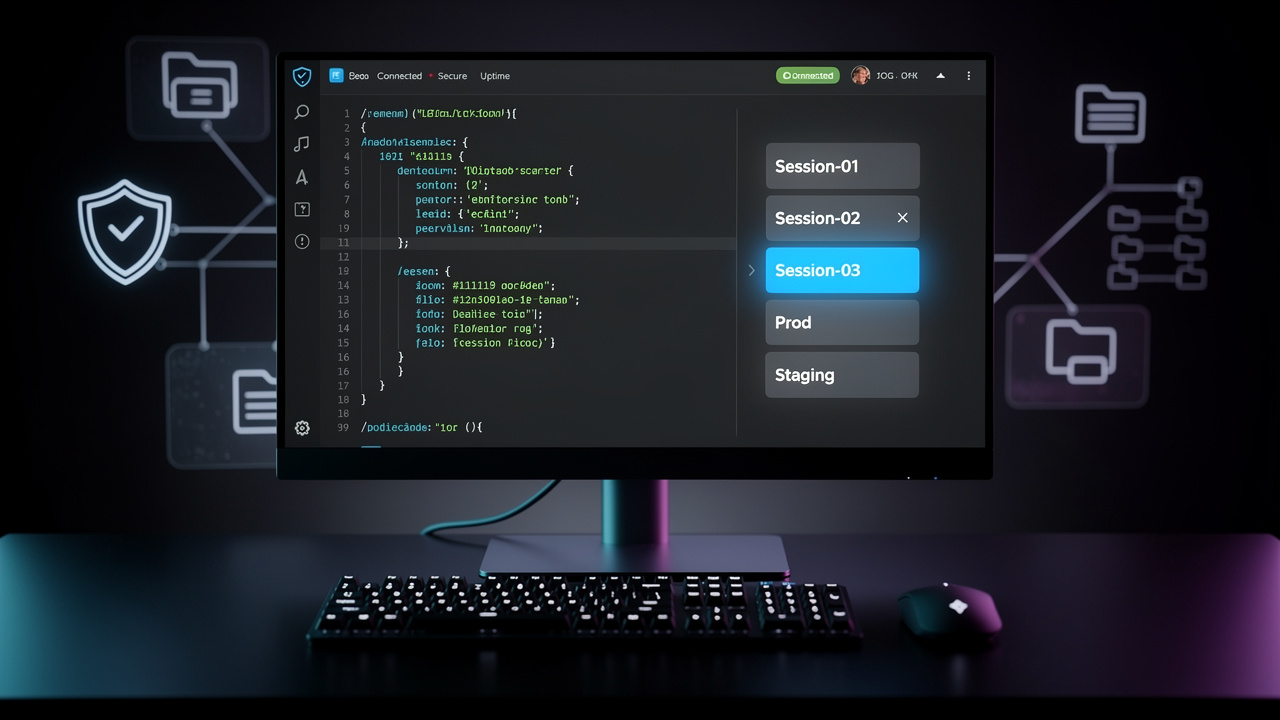

Aktualizacja obejmuje również zmiany wewnątrz samego silnika OpenCode. Usprawniono zarządzanie sesjami, co pozwala na stabilne zachowanie kontekstu podczas przełączania się między różnymi obszarami roboczymi.

Wprowadzono także normalizację metadanych dostawców. Zmiana ta zapewnia poprawne wyświetlanie informacji o modelach nawet wtedy, gdy dane pochodzące z zewnętrznych katalogów są niekompletne.

Rozwój narzędzia i stabilność

Wprowadzone modyfikacje wskazują na to, że twórcy OpenCode skupiają się na usuwaniu błędów technicznych i upraszczaniu obsługi. Lepsza diagnostyka błędów w usługach Cloudflare eliminuje problemy przy starcie, a poprawki w TUI ułatwiają codzienną pracę. Te aktualizacje, wraz z poprawą stabilności rdzenia systemu, sprawiają, że narzędzie staje się bardziej przewidywalne. Regularne wydawanie poprawek pokazuje, że projekt jest rozwijany na podstawie zgłoszeń przesyłanych przez użytkowników.