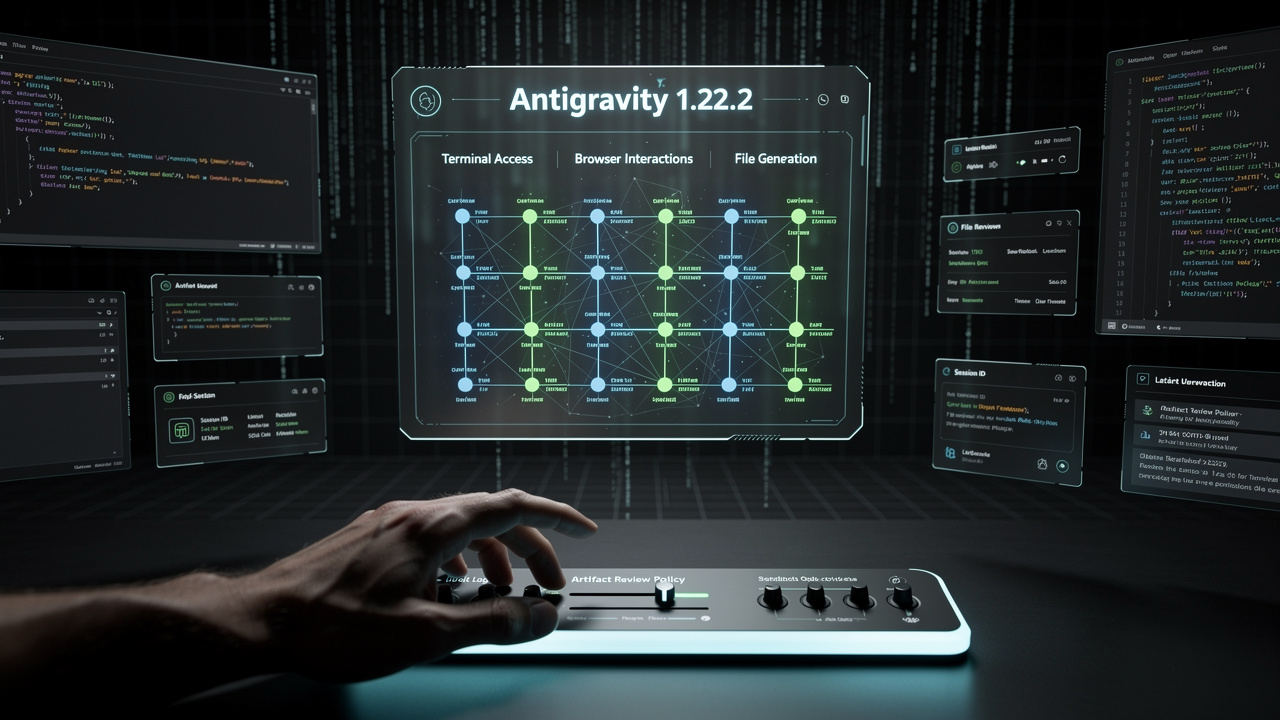

Google opublikowało aktualizację 1.22.2 dla środowiska programistycznego Antigravity. Główną zmianą jest wprowadzenie systemu uprawnień dla agentów AI, który zastępuje dotychczasowe rozwiązania w zakresie bezpieczeństwa i kontroli nad automatyzacją kodu. Aktualizacja trafia do użytkowników etapami.

Nowy mechanizm pozwala precyzyjnie określić, jakie działania agent może podejmować w imieniu programisty. Każda operacja – od wpisywania komend w terminalu po interakcje z przeglądarką i generowanie plików – jest teraz traktowana jako osobny zasób uprawnień. Dzięki temu użytkownicy mają większy wpływ na to, co dzieje się w ich lokalnym środowisku.

Kontrola nad zadaniami agenta

Agent w wersji 1.22.2 to system wnioskowania korzystający z modeli językowych klasy frontier. Narzędzie tworzy listy zadań, plany wdrożeń oraz nagrania z sesji w przeglądarce. Wcześniej zarządzanie tymi procesami było mało dokładne, co zmienia obecna aktualizacja.

W panelu Agent Manager oraz w ustawieniach systemowych pojawiły się trzy główne zasady kontroli. Pierwsza z nich, polityka przeglądu artefaktów (Artifact Review Policy), określa sytuacje, w których agent musi zatrzymać pracę i poczekać na akceptację człowieka. Użytkownik może wybrać tryb „Always Proceed”, aby przyspieszyć proces, co jednak wiąże się z mniejszym nadzorem nad wynikami.

Druga zasada dotyczy wykonywania poleceń w terminalu. Wykorzystuje ona listy dozwolonych i zabronionych komend (allowlists/blocklists). Pozwala to na automatyczne uruchamianie bezpiecznych operacji, takich jak npm install, przy jednoczesnym blokowaniu ryzykownych skryptów. Trzecia funkcja to polityka JavaScriptu w przeglądarce, która uniemożliwia uruchamianie niezaufanego kodu JS. Ma to chronić przed atakami typu prompt injection podczas testowania aplikacji.

Naprawione błędy i problemy techniczne

Wersja 1.22.2 eliminuje błąd, który powodował wyświetlanie zbędnych próśb o dostęp do terminala, nawet jeśli użytkownik zaznaczył opcję „Always run”. Dokumentacja potwierdza naprawę tej usterki, choć monity dotyczące adresów URL w przeglądarce mogą nadal występować.

Wdrożenie nowych zabezpieczeń wiąże się też z pewnymi trudnościami. Wprowadzony wcześniej sandboxing (w wersji 1.21.6) wywołał u części osób problemy z uprawnieniami Dockera, głównie na systemie macOS. Ponieważ system wymusza aktualizacje do najnowszej wersji, niektórzy specjaliści DevOps nie mogą wrócić do starszego, stabilnego wydania. Odnotowano również przypadki błędów weryfikacji konta u użytkowników z aktywną subskrypcją, co prawdopodobnie wynika z przebudowy systemu autoryzacji.

Bezpieczeństwo w pracy z AI i DevOps

Nowy system uprawnień to kolejny etap rozwoju narzędzia w stronę bezpiecznego programowania wspomaganego przez AI. Dla osób pracujących w modelu „vibe coding” lub automatyzujących procesy DevOps, szczegółowe definiowanie uprawnień agenta ogranicza ryzyko przypadkowego usunięcia danych, uruchomienia złośliwego skryptu czy wejścia na niebezpieczną stronę podczas testów.

Zmiany w wersji 1.22.2 przygotowują grunt pod dalszy rozwój autonomii agentów. Google dąży do modelu, w którym samodzielność sztucznej inteligencji jest ograniczona konkretnymi ramami ustawionymi przez człowieka. Dla zespołów zajmujących się tworzeniem stron internetowych i rozwojem AI oznacza to bardziej przewidywalne warunki pracy przy testowaniu nowych metod budowania aplikacji.