Wydanie Codex 0.117.0 przynosi kluczową zmianę w postrzeganiu wtyczek, czyniąc z nich fundament platformy. Ta aktualizacja nie tylko porządkuje zarządzanie pluginami, ale też znacząco rozwija możliwości systemów multi-agent i stabilizuje środowisko wykonawcze. Dla programistów i zespołów DevOps to krok w stronę zunifikowanego, wielofunkcyjnego środowiska pracy wspieranego przez sztuczną inteligencję.

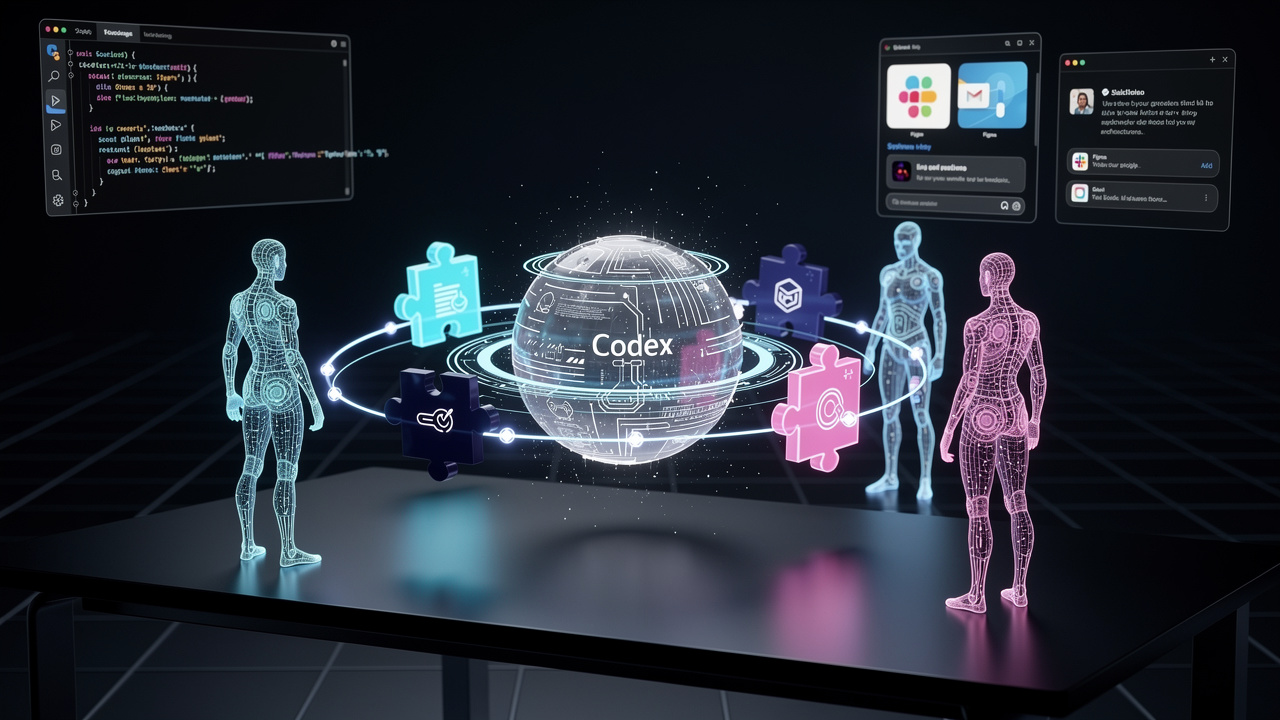

Pluginy stają się elementem typu First-Class

Najważniejszą nowością w Codex 0.117.0 jest traktowanie pluginów jako first-class workflow. To nie tylko dodanie nowej funkcji, ale fundamentalna zmiana w architekturze. System zaprojektowano tak, aby ułatwić współdzielenie tej samej konfiguracji między projektami lub zespołami. Zarządzanie konfiguracją odbywa się poprzez pliki config.toml i .codex/config.toml.

Zarządzanie narzędziami jest intuicyjne. System przeprowadza użytkownika przez procesy uwierzytelniania i konfiguracji podczas instalacji, a stan wtyczek jest synchronizowany zdalnie. Co kluczowe, pojawił się także katalog starannie wyselekcjonowanych pluginów z gotowymi integrjami dla popularnych narzędzi, takich jak Slack, Notion, Figma, Gmail i Google Drive.

Dla zaawansowanych użytkowników Codex oferuje wsparcie dla Skills i integracji z MCP (Model Context Protocol). Wzmianki @plugin automatycznie dołączają powiązany kontekst, co przyspiesza pracę. Rozszerzenia IDE dla VS Code i Cursor zapewniają spójny dostęp do tych funkcji.

Zaawansowane systemy multi-agent i obsługa obrazów

Aktualizacja 0.117.0 przynosi też istotne ulepszenia pod maską, szczególnie w obszarze współpracy wielu agentów AI. Wprowadzono wsparcie dla MCP i Skills, co umożliwia agentom efektywniejszą współpracę i przekazywanie zadań z pełnym zachowaniem kontekstu.

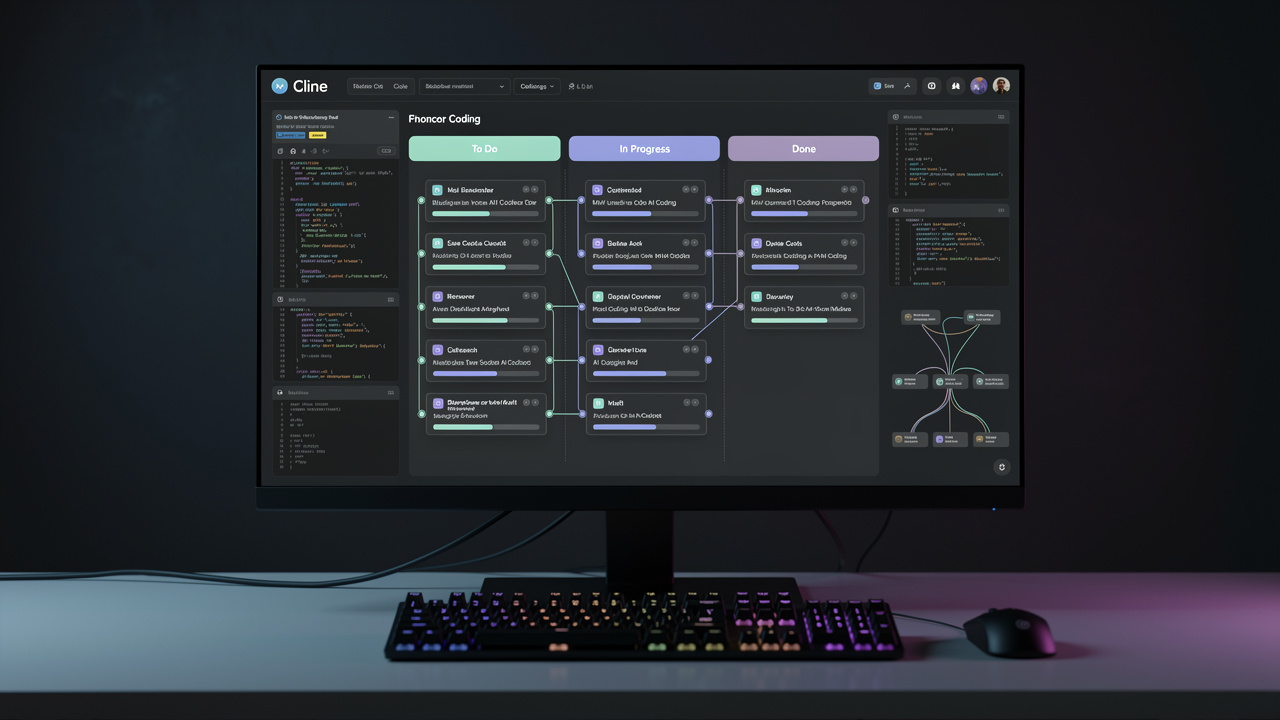

Interfejs użytkownika również stał się bardziej inteligentny. Ulepszony selektor wzmianki $ priorytetyzuje teraz pluginy, Skills i aplikacje.

W zakresie obsługi multimediów narzędzie js_repl udostępnia teraz zmienne codex.cwd i codex.homeDir, co ułatwia nawigację po systemie plików. Ponadto referencje do obrazów wygenerowanych za pomocą codex.emitImage(...) lub wyników narzędzi z codex.tool(...) są teraz trwale przechowywane i dostępne między różnymi komórkami kodu, co ułatwia iteracyjną pracę z grafiką.

Większa stabilność i bezpieczeństwo środowiska wykonawczego

Dla deweloperów codziennie pracujących w terminalu ta wersja Codex przynosi istotne usprawnienia stabilności. Przeprojektowano sposób wykonywania poleceń, dodając pełne wsparcie dla strumieniowania stdin/stdout/stderr oraz dla terminali TTY/PTY.

Jednym z najważniejszych zabezpieczeń jest scalanie uprawnień wykonywalnych z polityką sandboxa na turę. To rozwiązanie znacząco zwiększa bezpieczeństwo wykonywania zewnętrznych poleceń, na przykład w forkowanych shellach zsh.

Aktualizacja obejmuje też liczne poprawki błędów dotyczące procesów uwierzytelniania i działania narzędzi w środowisku izolowanym (sandboxed tool execution), co przekłada się na znacznie bardziej przewidywalne i niezawodne środowisko programistyczne.

Podsumowanie: Codex ewoluuje w platformę workflow

Wydanie Codex 0.117.0 wyraźnie pokazuje, jak narzędzie ewoluuje z asystenta kodowania w kompleksową platformę workflow dla zespołów. Dzięki uczynieniu pluginów centralnym elementem, Codex otwiera się na integracje z całym ekosystemem narzędzi deweloperskich i biznesowych.

Ulepszenia systemów multi-agent i stabilności terminala bezpośrednio wspierają codzienne praktyki web developmentu i DevOps, podczas gdy nowe możliwości zarządzania pluginami przyspieszają tworzenie płynnego, zautomatyzowanego środowiska pracy. Dla zespołów, które chcą standaryzować swoje setupy i budować wieloetapowe, oparte na współpracy procesy AI, ta wersja stanowi solidny fundament pod dalszy rozwój.