Do stabilnej gałęzi edytora Zed trafiła wersja 0.231.1, która wprowadza natywną implementację devcontainerów, jedną z najbardziej oczekiwanych funkcji dla zespołów deweloperskich. Wraz z tą aktualizacją pojawiły się również istotne usprawnienia w zakresie pracy ze sztuczną inteligencją oraz szereg poprawek stabilnościowych. To krok w stronę zunifikowanego środowiska, które łączy lokalny komfort pracy z powtarzalnością kontenerów oraz asystą AI.

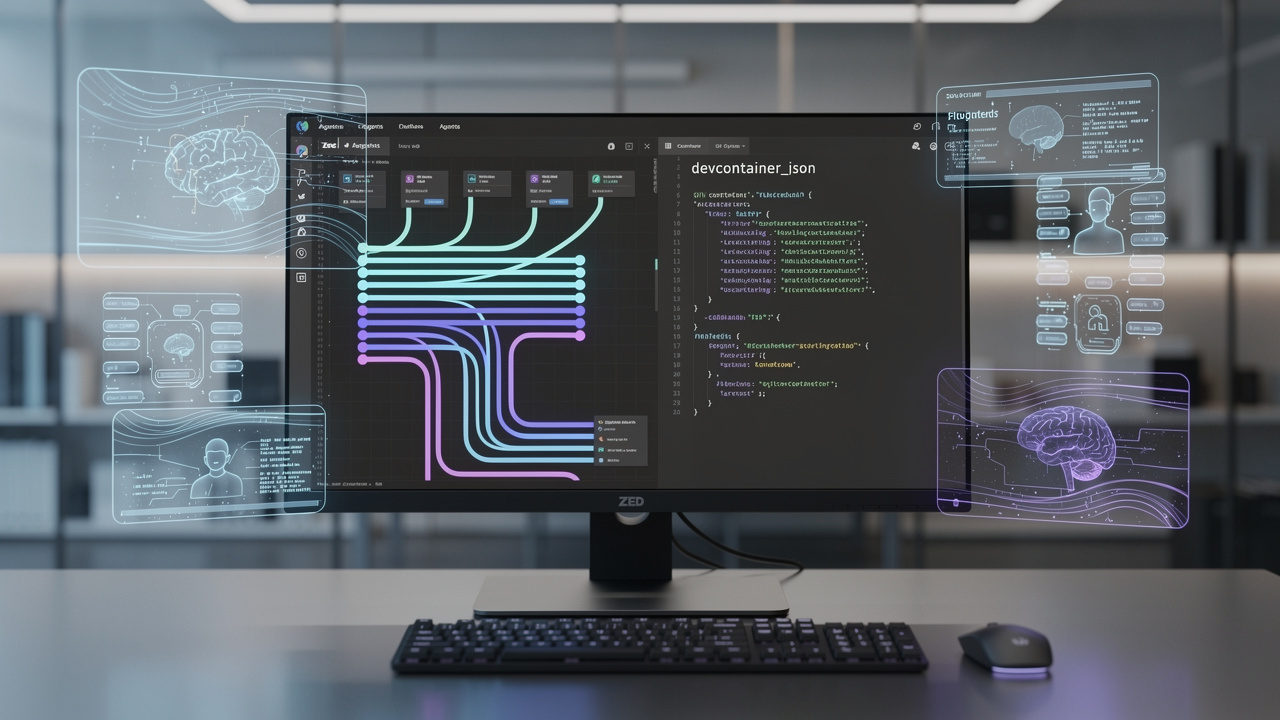

Kluczową zmianą jest zastąpienie zewnętrznej aplikacji CLI devcontainer, opartej na Node.js, natywnym handlerem napisanym w Rust. Oznacza to, że Zed może teraz w pełni obsługiwać swoje własne rozszerzenia definiowane w pliku .devcontainer/devcontainer.json poprzez sekcję customizations.zed.extensions. Gdy projekt zawiera odpowiednią konfigurację, edytor automatycznie zaproponuje opcję „Open in Container”, co zbuduje obraz (jeśli jest wymagany), uruchomi kontener i przeładuje projekt wewnątrz niego.

Kluczowe zmiany w wersji 0.231.1

- Natywne devcontainery: Zewnętrzne narzędzie CLI zostało zastąpione własną implementacją w Rust, co umożliwia pełne wsparcie dla rozszerzeń Zed.

- Ulepszenia agenta AI: Wprowadzono top-down streaming dla wątków agenta, co zapewnia lepsze automatyczne przewijanie podczas generowania długich odpowiedzi.

- Optymalizacja tokenów: Zmniejszono zużycie tokenów w opisach narzędzi dostępnych dla agentów, co może przekładać się na niższe koszty i szybsze działanie.

- Ulubione kanały współpracy: W panelu współpracy dodano możliwość oznaczania kanałów jako ulubione, co ułatwia poruszanie się po aktywnych projektach zespołowych.

- Flaga CLI

--dev-container: Nowa flaga wiersza poleceń umożliwia automatyczne otwieranie projektu w kontenerze devcontainer, jeśli wykryta zostanie odpowiednia konfiguracja.

Natywna siła devcontainerów

Implementacja devcontainerów w Zedzie nie jest już zależna od zewnętrznego łańcucha narzędzi. Deweloperzy mogą teraz definiować potrzebne rozszerzenia Zed bezpośrednio w pliku devcontainer.json, co zapewnia spójność środowiska dla każdego członka zespołu. Nowy workflow jest prosty: edytor wykrywa plik .devcontainer/devcontainer.json i wyświetla monit. Można także ręcznie użyć Palette Poleceń („Project: Open Remote”) lub modala Zdalnych Projektów.

Dodano nową flagę --dev-container do CLI Zeda, która automatycznie otwiera projekt w kontenerze, jeśli konfiguracja istnieje. To duże udogodnienie dla automatyzacji. Należy jednak pamiętać o obecnych ograniczeniach. Funkcja jest wciąż rozwijana, a edycja pliku devcontainer.json nie wywołuje automatycznego przebudowania – wymaga ręcznego zatrzymania i restartu kontenera. Wsparcie dla forwardowania portów jest obecnie ograniczone do appPort, a rozszerzenia są ładowane z hosta, bez oddzielnej zarządzanej puli w kontenerze.

AI głębiej zintegrowane z przepływem pracy

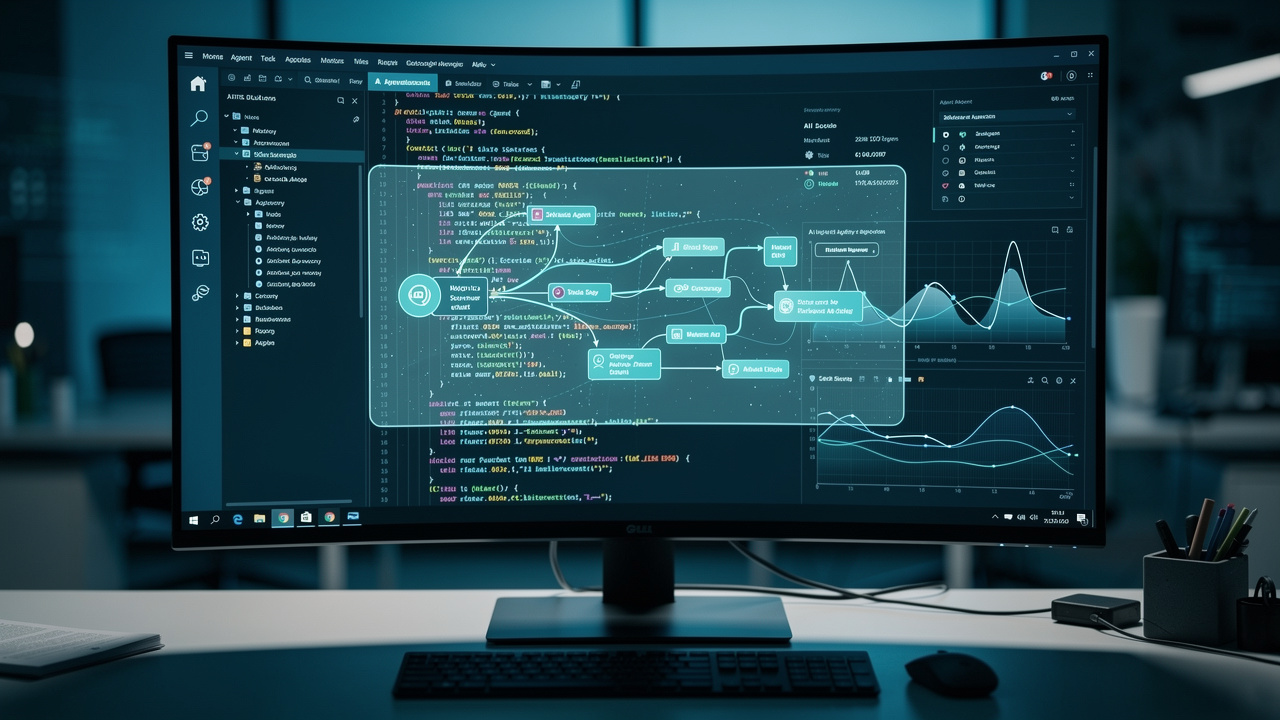

Drugi filar tej aktualizacji to znaczne dopracowanie funkcji sztucznej inteligencji. Zmiana z bottom-up na top-down streaming w wątkach agenta to więcej niż techniczny detal. Dzięki niej interfejs automatycznie przewija się do najnowszej treści generowanej przez model, co jest kluczowe dla wygody podczas długich sesji „vibe coding”. Agent lepiej radzi sobie z wyborem kontekstu z terminala, niezależnie od otwartych buforów.

Poprawiono interakcję z subagentami. Karty podglądu ich działań są teraz lepiej zarządzane – zawartość pozostaje widoczna do końca procesu, a potwierdzanie akcji jest płynniejsze. Dodano preferencje agentów specyficzne dla projektu, co pozwala na przypisanie specjalizowanego modelu AI do konkretnego repozytorium kodu. Wszystko to prowadzi do bardziej naturalnej i skutecznej współpracy z asystentem, bez zbędnego przeskakiwania między kontekstami.

Stabilizacja i poprawki

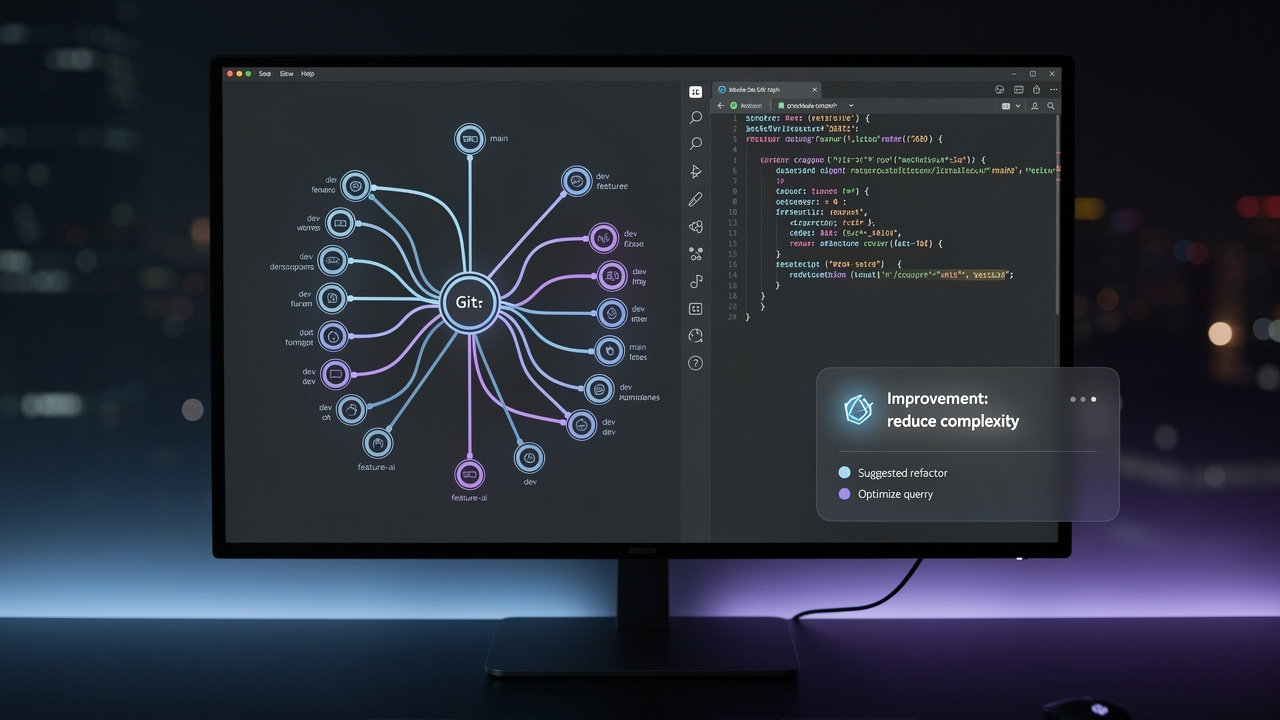

Oprócz flagowych nowości, wydanie 0.231.1 skupia się na utrzymaniu wysokiej jakości. Naprawiono wiele błędów, w tym problemy z obsługą etykiet (labels) w plikach Docker Compose przy otwieraniu devcontainerów, co blokowało część istniejących konfiguracji. Wprowadzono automatyczne przełączanie między widokiem diffa w formacie „split” a „unified” w zależności od szerokości panelu, co poprawia ergonomię przeglądania zmian w Gicie.

Usunięto również starszą, przestarzałą funkcję „Text Threads”, kontynuując oczyszczanie interfejsu. W ramach współpracy, oprócz ulubionych kanałów, utrwalono stan przełącznika „Show Occupied Channels” w panelu collab.

Podsumowanie wydania

Wydanie Zed 0.231.1 koncentruje się na dwóch fundamentach nowoczesnego developmentu: powtarzalnych, izolowanych środowiskach za pomocą natywnych devcontainerów oraz głęboko zintegrowanej asyście AI. Usunięcie zależności od Node.js w przypadku kontenerów to nie tylko kwestia wydajności, ale i niezależności. Ulepszenia agentów czynią z Zeda nie tylko edytor, lecz aktywne środowisko programistyczne, które wspiera dewelopera w całym procesie tworzenia kodu. Funkcja devcontainerów, mimo pewnych ograniczeń, stanowi solidny fundament pod przyszły rozwój, szczególnie dla zespołów działających w obszarach web developmentu, AI i DevOps.