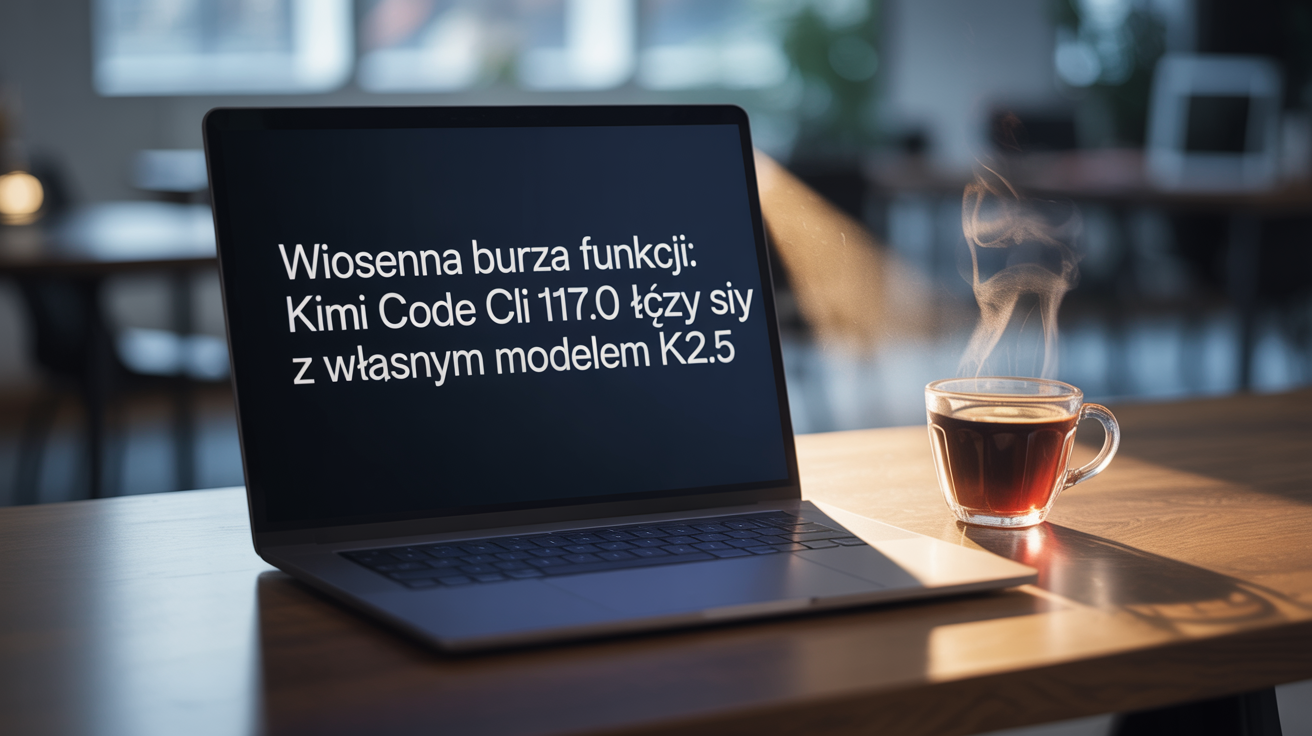

W świecie AI, gdzie każdy ogłasza przełom, czasem najgłośniejszym echem odbija się nie sam model, ale to, co ukryto drobnym drukiem. Tak właśnie stało się z Cursor Composer 2, narzędziem do kodowania, które zamiast aplauzu zebrało burzę krytyki. Chodzi o brak transparentności co do jego prawdziwego pochodzenia. Okazało się, że rozwiązanie chwalone jako własna, zaawansowana technologia Cursor, jest w istocie fine-tune'em chińskiego, open-source'owego modelu Kimi K2.5 od Moonshot AI.

Sprawa wyszła na jaw błyskawicznie, bo już w ciągu doby od premiery w marcu 2026 roku. To klasyczny przykład tego, jak społeczność deweloperów potrafi prześwietlić każdy szczegół, a firmy muszą liczyć się z konsekwencjami pominięcia kluczowej informacji.

Od głośnej premiery do szybkiego rozczarowania

Cursor, popularne środowisko programistyczne, ogłosiło Composer 2 z wielkim rozmachem. W komunikacie prasowym chwalono się, że ich nowy, własny model do kodowania przebija wydajnością samego Claude'a Opus 4.6 od Anthropic w kluczowych benchmarkach, oferując przy tym niższy koszt. To była historia, w którą łatwo było uwierzyć: mała, zwinnie rozwijająca się firma pokonuje giganta.

Entuzjazm nie trwał jednak długo. Deweloper o pseudonimie Finn odkrył w API Cursor ukryty identyfikator modelu, który jednoznacznie wskazywał na Kimi K2.5. Swoje odkrycie opublikował na platformie X, a dyskusja momentalnie przeniosła się na Hacker News. To nie były już tylko domysły – użytkownicy zaczęli analizować tokenizer i inne techniczne szczegóły, szukając podobieństw.

Potwierdzenie przyszło z najbardziej wiarygodnego źródła – od samych twórców bazy. Pracownicy Moonshot AI, chińskiej firmy stojącej za modelem Kimi, przeanalizowali dane z API Cursor i publicznie stwierdzili, że Composer 2 używa identycznego tokenizera i należy do rodziny modeli Kimi. Określili go nawet mianem „dalszo wytrenowanej” wersji ich open-source'owego dzieła.

Problem nie w użyciu, lecz w milczeniu

Tutaj zaczyna się sedno całego zamieszania. Kimi K2.5 jest dostępny na otwartej licencji, która wyraźnie wymaga jednoznacznego przypisania autorstwa (attribution). Licencja obliguje użytkownika do stwierdzenia wprost: „to jest Kimi K2.5”. W pierwotnym wpisie na blogu Cursor, ogłaszającym premierę Composer 2, nie padło ani słowo o Moonshot AI, Kimi czy jakiejkolwiek bazowej technologii. Model przedstawiono jako całkowicie własny wysiłek inżynieryjny.

Początkowo pojawiły się nawet oskarżenia, że Cursor nie tylko nie podał źródła, ale mógł też naruszyć warunki licencji lub nie uiścić należnych opłat. Sytuacja wyjaśniła się częściowo, gdy Moonshot AI wydało późniejsze oświadczenie. Firma potwierdziła, że Cursor uzyskał dostęp do modelu poprzez autoryzowaną, komercyjną umowę z platformą Fireworks AI. Nie było więc mowy o nielegalnym użyciu czy kradzieży własności intelektualnej.

Problem pozostał jednak ten sam: fundamentalny brak przejrzystości. Cursor zbudował narrację o własnym, przełomowym modelu, kompletnie pomijając fakt, że stoi na barkach olbrzyma – i to olbrzyma, który wyraźnie żądał uznania autorstwa.

Reakcja Cursor: Przyznanie się do błędu z opóźnieniem

Odpowiedź ze strony Cursor nadeszła po tym, jak dowody techniczne obiegły sieć. Współzałożyciel firmy (w doniesieniach prasowych wymieniany jako Michael Torell, Sualeh Asif lub po prostu „Robinson”) zabrał głos na platformie X. Jego oświadczenie było wyważone, ale jednoznacznie przyznawało się do winy.

„Jestem wielkim zwolennikiem open source… To był błąd, że nie wspomnieliśmy o bazie Kimi w naszym wpisie na blogu od samego początku. Naprawimy to przy kolejnym modelu” – napisał. To kluczowe zdanie przeniosło dyskusję z płaszczyzny prawnej na etyczną. Cursor nie zaprzeczał faktom technicznym, ale przyznał, że zawiódł w kwestii transparentności, która jest fundamentem w świecie open source.

Na forach dyskusyjnych Cursor społeczność programistów była podzielona. Wielu uznało, że sam fakt budowania zaawansowanego produktu na otwartej technologii jest słuszny i pragmatyczny. Jeden z użytkowników trafnie podsumował nastroje: „To, że Composer 2 to Kimi K2.5++, jest w porządku. Brak przejrzystości – już nie”.

Co tak naprawdę kryje się pod nazwą Composer 2?

Warto wyjaśnić techniczną naturę tego, co zrobił Cursor. Composer 2 nie jest zwykłym „reskinem” – czyli przepakowaniem tego samego produktu w nową oprawę. To raczej zaawansowany fine-tune, a możliwe, że także proces treningu z wykorzystaniem uczenia ze wzmocnieniem (RL), przeprowadzony na solidnej, otwartej bazie, jaką jest Kimi K2.5.

Taki proces pozwala znacznie poprawić zdolności modelu w wąskiej dziedzinie, jaką jest generowanie kodu. Efekt końcowy może być rzeczywiście lepszy od oryginału w specyficznych zadaniach, co potwierdzają benchmarki zaprezentowane przez Cursor. Firma nie skłamała co do wydajności. Jednak cała architektura bazowa, włączając w to tokenizer, pozostała niezmieniona i charakterystyczna dla rodziny modeli Kimi, co właśnie pozwoliło na tak szybką identyfikację.

Szersze konsekwencje: Lekcja dla całej branży AI

Ta z pozoru lokalna afera ma daleko idące implikacje dla sposobu, w jaki firmy technologiczne prezentują swoje osiągnięcia w erze AI.

Przejrzystość jako standard etyczny. Incydent potwierdził jasną tezę: korzystanie z open source to nie tylko prawo, ale i obowiązek informacyjny. Pominięcie przypisania autorstwa podważa zaufanie, które jest kluczowe w ekosystemie współpracy. To przestroga dla każdej firmy, która chce balansować między chronieniem własnego know-how a szanowaniem licencji, na których zbudowała swój produkt.

Rola społeczności w weryfikacji. Sytuacja pokazała też siłę oddolnego audytu. Dziś użytkownicy, deweloperzy i badacze mają narzędzia, by w ciągu kilku godzin zweryfikować marketingowe deklaracje poprzez analizę API, benchmarki czy tokenizery. Ogłoszenie premiery modelu to dopiero początek prawdziwego testu wiarygodności.

Geopolityczny wymiar open source. Sprawa nieoczekiwanie uwypukliła także trend geopolityczny. Chińskie firmy, takie jak Moonshot AI, stały się potężnymi graczami w dystrybucji zaawansowanych modeli AI. To komplikuje narrację o technologicznej supremacji Zachodu i rodzi pytania o długoterminowe konsekwencje takiej „dyplomacji open-source”.

Wpływ na praktyki rynkowe. Finalnie incydent może wymusić zmianę praktyk przy wprowadzaniu nowych modeli na rynek. Presja będzie rosła, by obok spektakularnych wykresów wydajności w komunikacie znalazło się również jasne określenie pochodzenia technologii. Wydajność przestanie być jedynym wyznacznikiem sukcesu; uczciwość i zgodność z duchem współpracy staną się równie istotne.

Podsumowanie: Wartość prawdy w erze marketingu

Sprawa Cursor Composer 2 to coś więcej niż chwilowa burza w mediach społecznościowych. To studium przypadku na temat tego, co naprawdę cenią deweloperzy i zaawansowani użytkownicy. Oczekują przełomów, ale wymagają szacunku dla otwartej współpracy, na której zbudowano współczesny ekosystem oprogramowania.

Cursor popełnił błąd, pomijając kluczową informację, ale jego późniejsza reakcja pokazuje, że lekcja została odrobiona. Dla reszty branży powinien to być wyraźny sygnał: budowanie na open source to mocna strona, a nie wstydliwy sekret. Szczerość co do pochodzenia technologii nie umniejsza wartości dopracowanego fine-tune'u czy wygodnego interfejsu – wręcz przeciwnie, buduje zaufanie i wiarygodność, które są o wiele trudniejsze do zdobycia niż kilka punktów procentowych w benchmarku. W dłuższej perspektywie to właśnie to zaufanie decyduje o sukcesie lub porażce.