Dla zespołów deweloperskich, które cenią sobie szybkość sztucznej inteligencji, ale nie chcą rezygnować z kontroli nad wrażliwym kodem, nadchodzi ważna zmiana. Cursor, popularne środowisko programistyczne z wbudowaną AI, wprowadza możliwość samodzielnego hostowania swoich agentów chmurowych. Oznacza to, że cały proces – od kodu źródłowego, przez sekrety, po wyniki buildów – może teraz pozostawać wyłącznie w Twojej infrastrukturze.

Ta nowa funkcjonalność odpowiada na kluczową potrzebę w branży: jak czerpać korzyści z zaawansowanej automatyzacji AI bez narażania bezpieczeństwa danych. To nie jest okrojona wersja. Agenci hostowani na własnych serwerach oferują identyczne możliwości co ich chmurowe odpowiedniki z infrastruktury Cursor.

Pełna moc, własna sieć

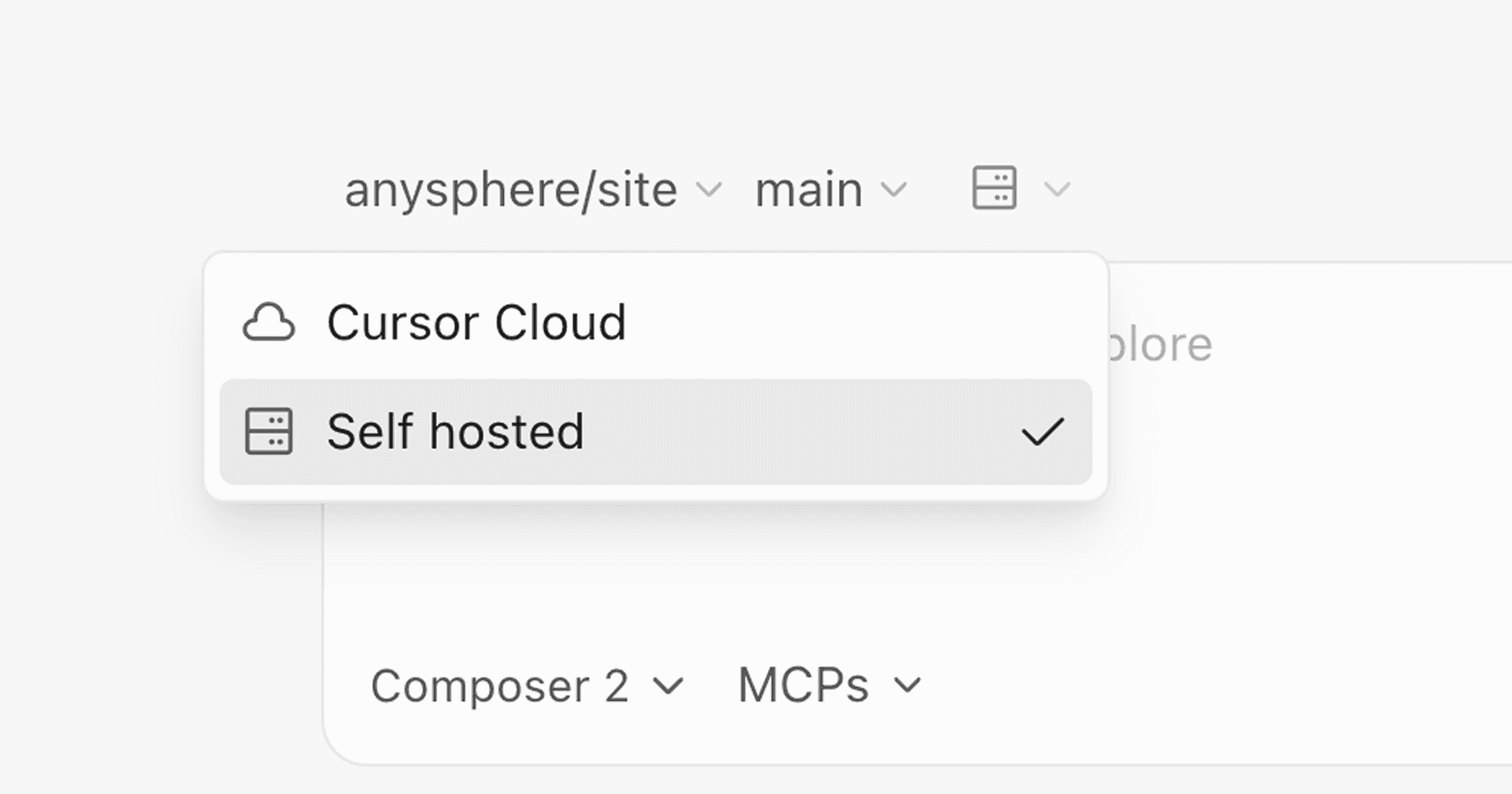

Na czym dokładnie polega ta funkcja? Zamiast wysyłać zadania do maszyn wirtualnych zarządzanych przez Cursor, możesz uruchomić tzw. workerów na własnym sprzęcie. Mogą to być serwery on-premise, prywatne chmury w modelu VPC (Virtual Private Cloud) czy instancje u dostawców takich jak Google Compute Engine. Cursor dostarcza specjalny „harness” – zestaw narzędzi do uruchomienia agenta – a reszta pozostaje u Ciebie.

To rozwiązanie zachowuje wszystkie flagowe możliwości agentów:

- Izolowane środowiska: Każdy agent działa w dedykowanej maszynie wirtualnej z pełnym dostępem do terminala, przeglądarki i pulpitu. Brak współdzielenia zasobów gwarantuje optymalną wydajność przy równoległym uruchamianiu wielu zadań.

- Wielomodelowość: Agenci są kompatybilni z nowym Composer 2 od Cursor lub praktycznie z dowolnym modelem klasy „frontier” od głównych dostawców.

- Rozszerzalność: Wspierane są pluginy, MCP (Model Context Protocol) do integracji z zewnętrznymi narzędziami, subagenci oraz reguły automatyzacji.

Kluczowa jest tu rola Cursor: platforma nadal odpowiada za interfejs użytkownika, orkiestrację zadań (czyli decydowanie, który agent co wykonuje), dostęp do modeli językowych i dashboard. Cała „robocza” część z kodem i danymi nie opuszcza jednak Twojej sieci.

Bezpieczeństwo i „vibe coding” w praktyce

Dla sektorów takich jak finanse, zdrowie czy szeroko pojęty enterprise, gdzie compliance i polityki bezpieczeństwa są priorytetem, ta opcja jest długo wyczekiwaną odpowiedzią. Jak zauważono w materiałach, jeden z dostawców usług finansowych komentuje, że dzięki self-hosted agents może zbudować workflow dla niemal 1000 inżynierów, pozwalający na tworzenie pull requestów bezpośrednio ze Slacka.

To właśnie jest esencja tzw. vibe coding – koncepcji, w której deweloper staje się bardziej architektem i recenzentem, podczas gdy agenci AI wykonują rutynową lub złożoną pracę programistyczną. Teraz można to robić bez obaw o wyciek własności intelektualnej czy konfiguracji. Zespoły DevOps zachowują pełną kontrolę nad środowiskiem build, siecią wewnętrzną i politykami bezpieczeństwa, jednocześnie odciążając się od zarządzania infrastrukturą pod samą AI.

Co ciekawe, społeczność już eksperymentuje z zaawansowanymi zastosowaniami, takimi jak uruchamianie agentów z dostępem do potężnych układów GPU Nvidii na GCE w celu przeprowadzania ewaluacji modeli obrazu czy innych wymagających zadań AI.

Jak zacząć i szerszy kontekst ekosystemu

Włączenie self-hosted cloud agents jest proste i odbywa się przez Cursor Dashboard. Wszystkie potrzebne instrukcje i dokumentacja są już dostępne.

To wydanie wpisuje się w szerszą, agentową ewolucję Cursor. Platforma nie jest już tylko edytorem z podpowiedziami, ale warstwą orkiestrującą dla autonomicznych asystentów. Inne niedawne innowacje to Mission Control (dashboard do śledzenia wielu zadań), Cloud Handoff (przekazywanie zadań do chmury jednym znakiem „&”) czy Cursor dla JetBrains poprzez Agent Client Protocol (ACP). Rynek pluginów rozrósł się do ponad 30 pozycji od partnerów takich jak Atlassian czy GitLab, a wbudowani agenci bezpieczeństwa, jak Vuln Hunter, automatycznie skanują kod pod kątem luk.

Nowy etap w hostowaniu AI dla deweloperów

Wprowadzenie self-hosted cloud agents przez Cursor to wyraźny sygnał, że przyszłość rozwoju oprogramowania z AI będzie hybrydowa. Nie chodzi o wybór między pełną kontrolą a nowoczesnością, ale o ich połączenie. Dla firm, które do tej pory z rezerwą podchodziły do przetwarzania swojego kodu w zewnętrznych serwisach AI, otwiera to drzwi do bezpiecznego eksperymentowania i produktywnego wdrażania automatyzacji.

Jest to krok istotny nie tylko dla bezpieczeństwa, ale też dla elastyczności. Pozwala dopasować moc obliczeniową agentów do specyficznych potrzeb projektu – czy to pod kątem specjalistycznego sprzętu, lokalizacji danych, czy integracji z wewnętrznymi narzędziami DevOps. W rezultacie zespoły zyskują potężnego, autonomicznego współpracownika, który działa tam, gdzie one chcą, zachowując pełną zgodność z ich infrastrukturą.