Najnowsze aktualizacje Codex, autonomicznego agenta AI do kodowania i automatyzacji od OpenAI, wprowadzają szereg znaczących ulepszeń, które mogą zmienić sposób pracy deweloperów. Najważniejsze nowości skupiają się na integracjach, narzędziach CLI/SDK oraz stabilności codziennych workflowów. To nie tylko rozwój funkcjonalności, ale też solidna porcja usprawnień technicznych.

Integracje z narzędziami designerskimi i komunikacyjnymi

Jednym z kluczowych obszarów rozwoju są integracje z popularnymi platformami, takimi jak Figma. Pozwala to deweloperom i designerom na płynną współpracę, w której Codex może asystować przy analizie interfejsów użytkownika (UI) i flow projektowych bezpośrednio w znanych narzędziach. Podobne integracje z platformami komunikacyjnymi, takimi jak Slack, umożliwiają włączanie automatyzacji do codziennej komunikacji zespołowej.

Te połączenia wskazują na ewolucję Codex z narzędzia stricte programistycznego w stronę platformy automatyzacji procesów deweloperskich i projektowych, działającej w kontekście istniejących aplikacji.

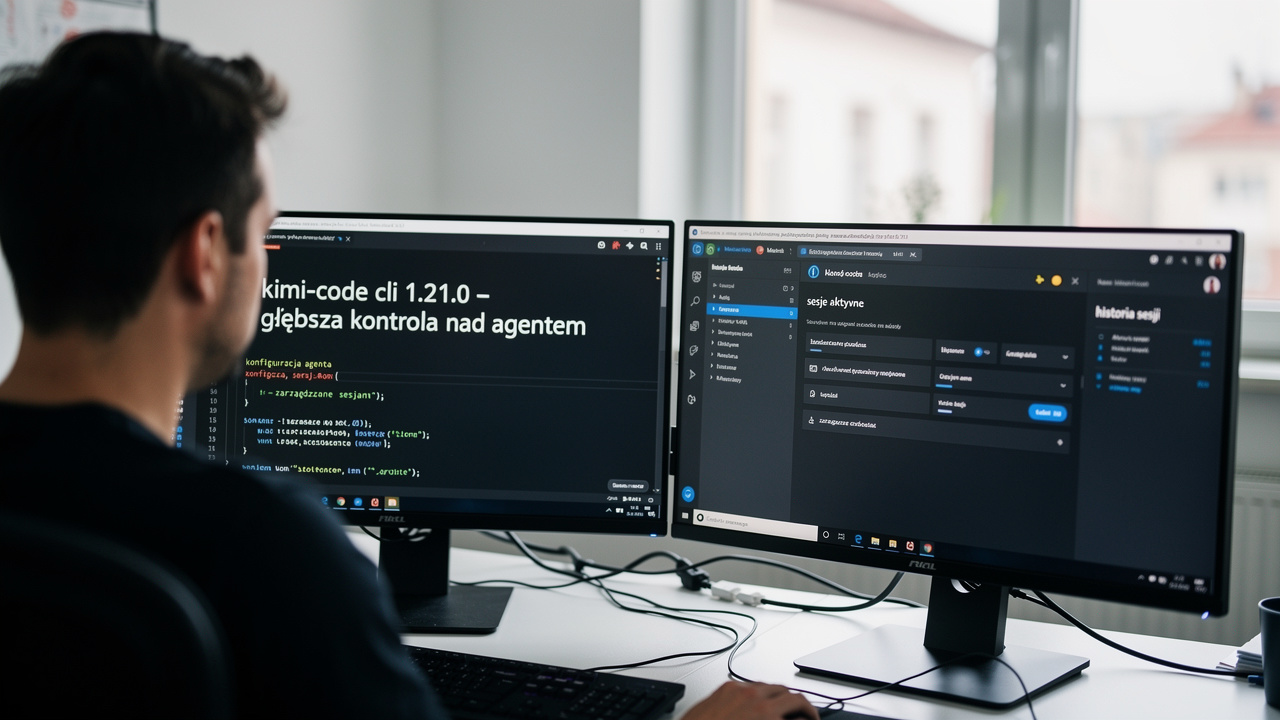

Rozwój CLI, SDK i środowiska deweloperskiego

Codex oferuje rozbudowane narzędzia wiersza poleceń (CLI) oraz SDK (głównie w TypeScript), które stanowią podstawę interakcji z agentem. Środowisko to jest stale rozwijane, aby zapewnić programistom potężne i elastyczne możliwości automatyzacji.

Funkcjonalności obejmują zaawansowane zarządzanie wykonywaniem poleceń ze wsparciem dla streamingu stdin/stdout/stderr oraz TTY/PTY. Dla deweloperów pracujących z terminalami i kontenerami to istotne usprawnienie, które pozwala na lepszą integrację z istniejącym ekosystemem. SDK pozwala programistom łatwo integrować operacje Codexa z ich własnym kodem, zapewniając kontrolowany dostęp do automatyzacji.

Stabilność i bezpieczeństwo automatyzacji

Każda duża aktualizacja przynosi też poprawki stabilności i bezpieczeństwa, kluczowe dla zautomatyzowanych workflowów.

Ulepszenia dotyczą bezpieczeństwa i izolacji podczas uruchamiania zautomatyzowanych agentów i subagentów, co stanowi fundament zaufania do platformy. Poprawki w obszarze routingu i normalizacji wewnętrznych procesów zmniejszają ryzyko błędów przy złożonych automatyzacjach.

Warto też zauważyć zwiększoną transparentność działań agenta – użytkownik ma lepszy wgląd w to, jakie operacje i z jakimi parametrami zostaną wykonane, zanim wyrazi na nie zgodę.

Ekosystem rozszerzeń i workflow deweloperów

Rozwój nie ominął też ekosystemu rozszerzeń. Wprowadzane są lepsze integracje aplikacji oraz ulepszone workflowy dla pluginów.

Dla deweloperów oznacza to łatwiejsze znajdowanie i włączanie potrzebnych funkcjonalności do projektów, choć obecnie odbywa się to raczej przez bezpośrednie integracje niż scentralizowany marketplace. Dbałość o odpowiednie uprawnienia i weryfikację źródeł pluginów podczas instalacji redukuje ryzyko naruszenia bezpieczeństwa i ułatwia zarządzanie zależnościami.

Wnioski

Najnowsze aktualizacje Codex idą w dwóch kierunkach: poszerzają konkretne możliwości integracyjne z kluczowymi narzędziami deweloperskimi oraz solidnie wzmacniają istniejącą bazę, zwiększając stabilność, bezpieczeństwo i ergonomię pracy.

Dla deweloperów codziennie korzystających z automatyzacji poprawki w wykonywaniu poleceń i bezpieczeństwie będą najbardziej odczuwalne w bieżącej pracy. Dla osób budujących bardziej złożone systemy rozwinięte SDK i integracje otwierają nowe możliwości włączania AI do szerszych procesów.

OpenAI rozwija Codex nie tylko jako asystenta kodowania, ale jako platformę do zaawansowanej automatyzacji developer workflow. Rozwój skupia się zarówno na głębi (zaawansowane SDK, integracje), jak i na szerokości (poprawki stabilności, ulepszenia UX). To dobry kierunek dla wszystkich, którzy oczekują spójnego i bezpiecznego środowiska do automatyzacji całych procesów wytwarzania oprogramowania.