OpenAI wydało nową wersję swojego agenta programistycznego Codex, oznaczoną numerem 0.120.0. Aktualizacja, opublikowana w kwietniu 2026 roku, koncentruje się na ulepszeniu funkcji Realtime V2, poprawie doświadczenia użytkownika w terminalu (TUI) oraz naprawie kluczowych błędów, zwłaszcza na platformie Windows. To kolejny krok w rozwoju narzędzia, które wspiera programistów w automatyzacji długoterminowych zadań związanych z web developmentem, AI i devops.

W tej wersji wprowadzono mechanizm strumieniowania postępu pracy agentów w tle, co umożliwia użytkownikom śledzenie działań agenta, nawet gdy jest on zajęty innym zadaniem. Interfejs terminala stał się bardziej czytelny, a deweloperzy zyskali nowe możliwości jego konfiguracji, co ma na celu zwiększenie płynności i przewidywalności pracy z agentem.

Kluczowe zmiany w wersji 0.120.0

- Ulepszone Realtime V2: System teraz strumieniuje postęp agentów działających w tle (background agent progress streaming) i kolejkowuje ich odpowiedzi, czekając na zakończenie aktywnych zadań. Dzięki temu interakcje są bardziej uporządkowane.

- Przejrzystszy interfejs TUI: Aktywność haków (hook activity) jest teraz lepiej widoczna – działające haki są pokazywane osobno, a ukończone dane wyjściowe są zachowywane tylko wtedy, gdy są przydatne. Dodano też możliwość customizacji linii statusu, np. o zmienione tytuły wątków.

- Ważne poprawki stabilności: Naprawiono problemy z obsługą Windows elevated sandbox oraz ze stabilnością połączeń remote websocket. Poprawiono też kolejkowanie odpowiedzi i czyszczenie zasobów MCP.

Co nowego w Realtime V2 i strumieniowaniu?

Główną nowością tej wersji jest znacząca aktualizacja dla Realtime V2. Mechanizm background agent progress streaming pozwala Codex na bieżąco informować użytkownika o postępach agenta, który pracuje w tle nad długotrwałym zadaniem. Użytkownicy otrzymują aktualizacje na żywo z drugiego planu, co nie blokuje głównego wątku konwersacji.

Wprowadzono również inteligentne response queuing. Jeśli agent wyśle kolejną odpowiedź, zanim użytkownik skończy czytać poprzednią, system ją zakolejkuje i wyświetli we właściwym momencie. To eliminuje problem nakładających się wiadomości i poprawia płynność dialogu. Dodatkowo, agenci działający w tle otrzymują teraz transkrypty delta i mogą pozostać „cicho”, gdy nie ma potrzeby się odzywać, co redukuje szum informacyjny.

Usprawnienia interfejsu terminala (TUI)

Interfejs użytkownika w terminalu przeszedł kosmetyczny i funkcjonalny lifting. Zmiany w wyświetlaniu hook activity ułatwiają szybkie skanowanie ekranu i identyfikację aktualnie uruchomionych oraz zakończonych haków. To praktyczna poprawka dla każdego, kto korzysta z haków do automatyzacji.

Możliwość customizacji linii statusuto kolejne udogodnienie. Deweloperzy mogą teraz włączyć do niej zmienione nazwy wątków, co ułatwia zarządzanie wieloma równoległymi sesjami. Poprawki objęły także deklaracje narzędzi w trybie kodu (code-mode tool declarations), które teraz zawierają szczegóły outputSchema z MCP, co zapewnia lepsze typowanie ustrukturyzowanych wyników.

Poprawki błędów i niezawodność

Wydanie 0.120.0 przynosi szereg poprawek zwiększających stabilność. Dla użytkowników Windows kluczowa jest lepsza obsługa elevated sandbox, która teraz radzi sobie z wieloma wersjami CLI i różnymi ścieżkami instalacji. Naprawiono również problemy ze stabilnością zdalnych połączeń websocket, które mogły się zrywać podczas intensywnej wymiany danych.

Wprowadzono mechanizm rollout recording, który ponawia próby wysłania nieudanych danych analitycznych i informuje o trwałych awariach. To poprawia monitoring i diagnozowanie problemów. Co istotne, profile uprawnień (permission profiles) są teraz konsekwentnie utrzymywane pomiędzy sesjami TUI, co zapewnia spójność zasad bezpieczeństwa.

Podsumowanie

Wydanie Codex 0.120.0 to istotny krok w rozwoju tego agenta programistycznego. Twórcy skupili się na dopracowaniu kluczowych funkcji – strumieniowania w czasie rzeczywistym i użyteczności interfejsu – oraz na zwiększeniu stabilności systemu, szczególnie w trudnym środowisku Windows. Te zmiany przekładają się na bardziej płynne i przewidywalne doświadczenie pracy z narzędziem, które wspiera codzienne, długoterminowe zadania developerskie.

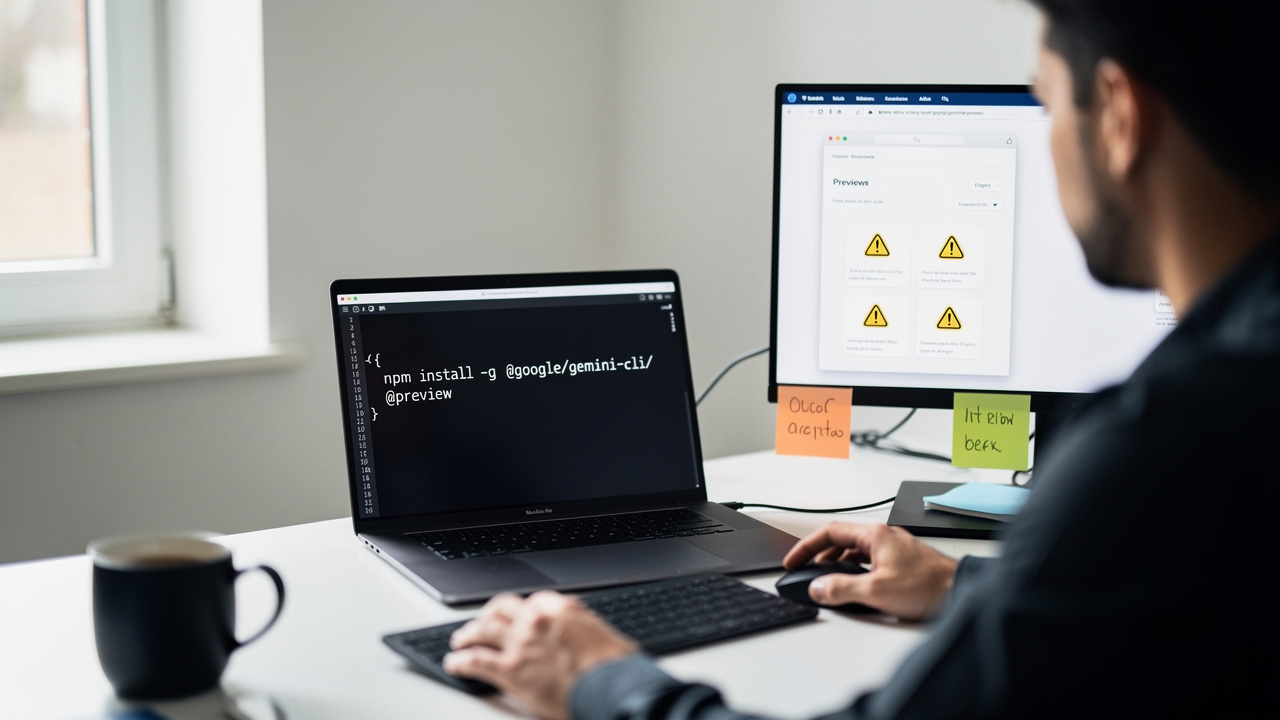

Aktualizację można zainstalować za pomocą komendy npm install -g @openai/[email protected]. Pełną listę zmian, obejmującą ponad 20 pull requestów, można znaleźć w changelogu projektu na GitHubie.