Premiera Cursor 2.0 wraz z nowym, autorskim modelem Composer 2 wywołała sporą burzę w środowisku deweloperów. Obietnica „przełomowej wydajności kodowania” za ułamek kosztów konkurencji brzmiała nieprawdopodobnie. Teraz, gdy pierwszy pył opadł, pojawiają się realne doświadczenia użytkowników. Okazuje się, że obraz jest zniuansowany – zachwyty mieszają się z rzeczową krytyką, ale ogólny kierunek zmian wydaje się obiecujący.

Wydajność na papierze kontra rzeczywistość

Nie ulega wątpliwości, że pod względem benchmarków Composer 2 robi ogromne wrażenie. Model, wyszkolony wyłącznie na zadaniach związanych z kodem, znacząco przebija swoje poprzednie wersje. W kluczowych testach, takich jak CursorBench (61.3), Terminal-Bench 2.0 (61.7) czy SWE-bench Multilingual (73.7), osiąga wyniki wyraźnie wyższe niż Composer 1.5. Twórcy Cursora chwalą się też, że domyślny, szybki wariant modelu (Composer 2 Fast) ma niższe opóźnienia niż GPT-5.4, a cała oferta jest o około 40% tańsza w przeliczeniu na tokeny wejściowe niż GPT-5.4. W porównaniu do poprzedniej generacji własnych modeli cena za milion tokenów wejściowych spadła o 86% (z 3,50 USD do 0,50 USD dla wariantu Standard).

W praktyce te liczby przekładają się na odczuwalną szybkość. Wielu użytkowników opisuje wrażenie pracy w czasie rzeczywistym. „Absolutnie fenomenalne” – tak niektórzy komentują płynność działania, która dla części programistów stała się powodem, by na dobre porzucić VS Code na rzecz Cursora. Przykłady są spektakularne: generowanie pełnego interfejsu użytkownika aplikacji w mgnieniu oka czy stworzenie działającego prototypu w ciągu dwóch minut bez używania zaawansowanych toolkitów.

Gdzie diabeł tkwi w szczegółach?

Entuzjazm wywołany szybkością nie oznacza jednak, że Composer 2 jest pozbawiony wad. Tutaj pojawiają się mieszane opinie. Gdy mowa o estetyce i „polocie” generowanego kodu, zwłaszcza w kontekście interfejsów użytkownika, model czasem odstaje od czołowych rozwiązań, takich jak Claude 4.6 Opus.

Jeden z praktycznych testów, polegający na zbudowaniu portalu HR, ujawnił tę różnicę. Podczas gdy Opus wygenerował nowoczesny, przyjazny interfejs porównywany do platformy Workday, output z modelu Composer 2 został opisany jako mniej atrakcyjny i wymagający dodatkowej iteracji. Inni użytkownicy zgłaszają, że początkowy kod bywa „szkieletowy” – jest funkcjonalny, ale wymaga refaktoryzacji i dopracowania, by nadać mu produkcyjną jakość. To pokazuje, że choć benchmarki (jak Terminal-Bench 2.0, gdzie Composer 2 zdobywa 61,7 punktu wobec 58,0 dla Opusa 4.6) mierzą poprawność, to w codziennej pracy liczy się też finalna elegancja i gotowość rozwiązania do wdrożenia.

Co nowego w Cursor 2.0 poza modelem?

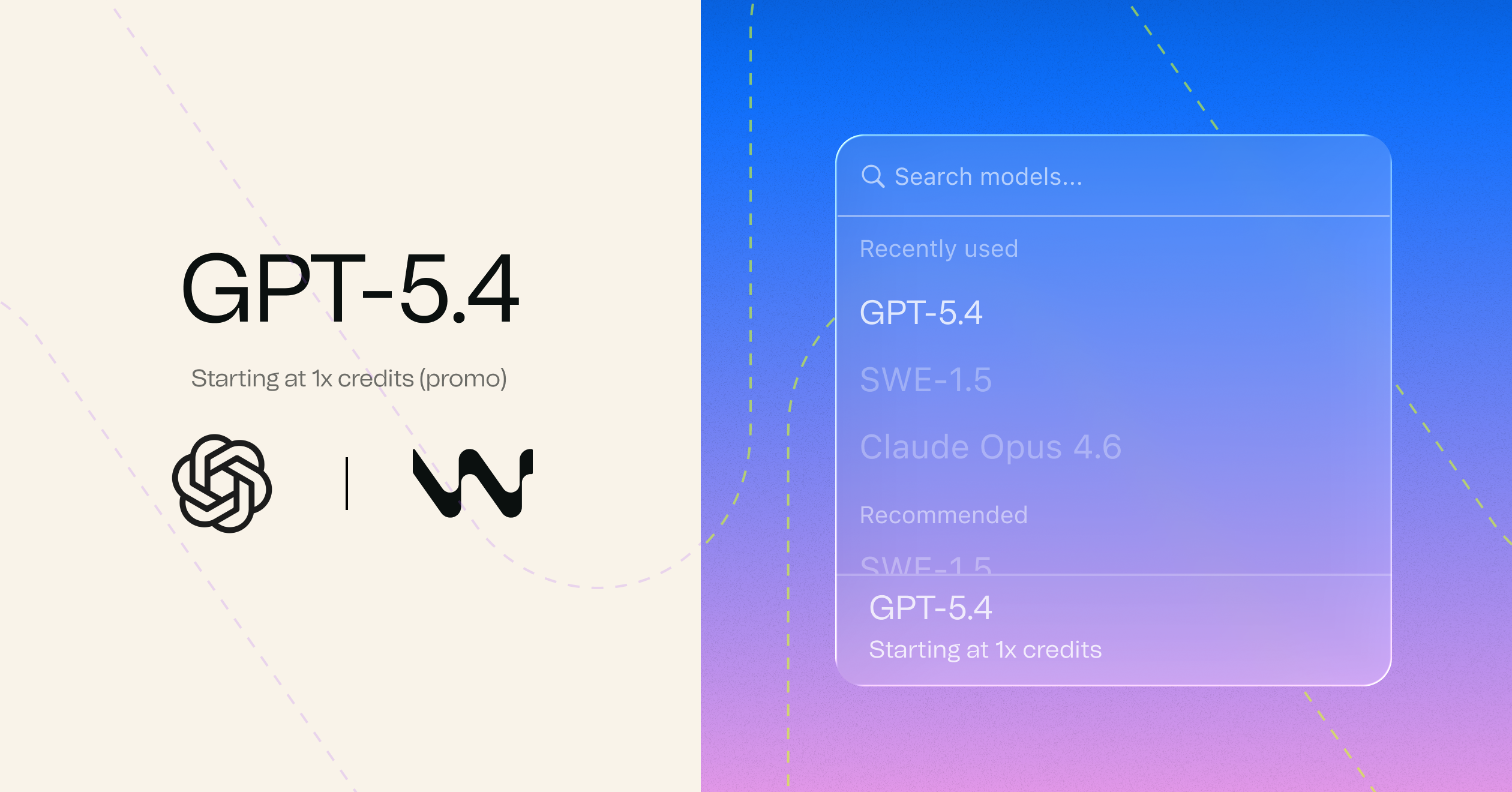

Sam edytor też przeszedł modernizację. Cursor 2.0 oferuje czystszy, bardziej dopracowany interfejs użytkownika, ulepszony flow recenzji kodu oraz wygodny wybór modeli. Pojawiły się zaawansowane możliwości edycji wieloplikowej i wbudowana przeglądarka, co usprawnia cały workflow programisty.

Warto wspomnieć o modelu Composer 1.5, który został wypuszczony w lutym 2026 roku, przed premierą Composer 2 (18 marca 2026). Stanowi on część ekosystemu, oferując zaawansowane możliwości, w tym edycję wieloplikową wspieraną technikami uczenia przez wzmacnianie (reinforcement learning). Jednak niektórzy profesjonalni użytkownicy mają zastrzeżenia do oferty darmowej. Domyślny, bezpłatny model Grok Code Fast bywa niewystarczający dla dużych codebase'ów, a brak wolniejszych, ale potężniejszych opcji fallback (typowych u konkurencji) bywa uciążliwy.

Podsumowanie: Obiecujący kierunek, ale to nie finał wyścigu

Pierwsze doświadczenia z Cursor 2.0 i Composer 2 malują obraz narzędzia, które gwałtownie przyspiesza i obniża koszty automatyzacji kodowania. Jego siłą jest niewątpliwie imponująca prędkość (oferowana przez domyślny wariant Fast) i bardzo korzystny stosunek inteligencji do ceny, co może zrewolucjonizować codzienną pracę nad zadaniami strukturalnymi.

Jednocześnie, w porównaniu z absolutną czołówką modeli ogólnych, wciąż widać różnicę w finalnym wykończeniu i estetyce generowanych rozwiązań, szczególnie frontendowych. Composer 2 wydaje się idealnym pomocnikiem do szybkiego prototypowania i iteracji, ale na ten moment może wymagać od programisty nieco więcej ręcznej pracy, by doprowadzić kod do stanu idealnego.

Mimo tych zastrzeżeń progres jest ewidentny. Cursor nie stoi w miejscu, a tempo ulepszeń sugeruje, że luka jakościowa może się szybko zmniejszać. Dla społeczności deweloperów pojawienie się tak mocnego, specjalistycznego i relatywnie taniego gracza (oferującego warianty Standard i Fast o tej samej inteligencji, ale różnej latencji i cenie) to znakomita wiadomość, która zdynamizuje cały rynek AI-assisted coding.