Najnowsza aktualizacja Codex, oznaczona numerem 0.111.0, przynosi istotną zmianę w domyślnej konfiguracji tego zaawansowanego asystenta programistycznego. Tryb Fast jest teraz włączany automatycznie dla wszystkich nowych sesji. Wprowadzono też wyraźny wskaźnik w interfejsie tekstowym (TUI), który informuje, czy sesja działa w trybie szybkim, czy standardowym. Te pozornie drobne modyfikacje mają duży wpływ na wydajność i przejrzystość pracy z narzędziem, choć – jak się okazuje – nie obyło się bez pewnych problemów.

Co oznacza tryb Fast w Codex?

Tryb Fast w Codex to ustawienie, które bezpośrednio wpływa na to, jak szybko asystent wykonuje wnioskowanie (inference) pomiędzy wątkami, agentami podrzędnymi (subagents) oraz podczas kompaktowania zadań. Przełączenie na Fast oznacza priorytet dla szybkości działania. W opisie funkcji podkreśla się, że zapewnia ona „najszybsze wnioskowanie kosztem 2-krotnie szybszego zużycia zasobów planu”.

To kluczowa informacja dla użytkowników. W trybie Standard Codex może działać bardziej zachowawczo, zarządzając zasobami w sposób zrównoważony. Tryb Fast zdejmuje te ograniczenia, co przekłada się na szybsze odpowiedzi, ale i szybsze zużywanie dostępnych limitów. Do tej pory użytkownik musiał ten tryb wybrać świadomie. W wersji 0.111.0 deweloperzy uznali, że większość osób preferuje szybkość, i ustawili ją jako opcję domyślną.

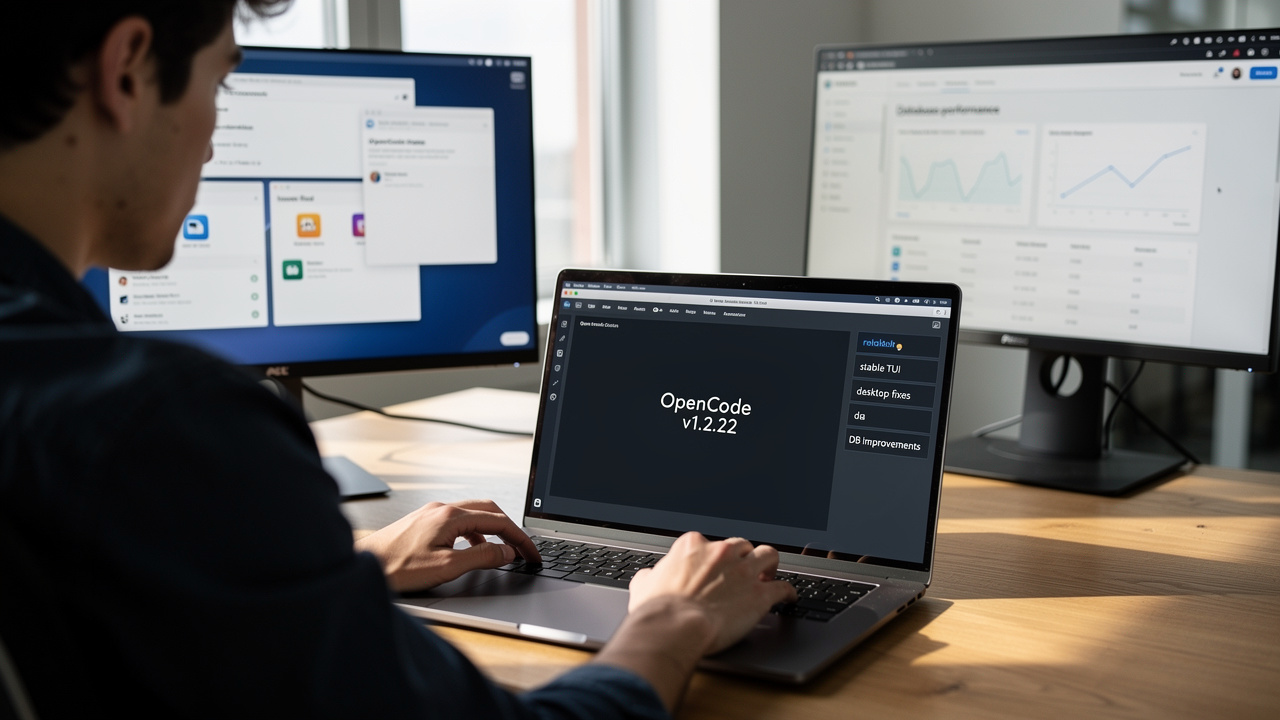

Drugim ważnym ulepszeniem jest modyfikacja interfejsu tekstowego. Nagłówek TUI wyraźnie wyświetla teraz informację o aktualnie aktywnym trybie sesji – Fast lub Standard. To nie tylko kwestia estetyki.

Dzięki temu programiści od razu widzą, w jakim trybie pracuje Codex. Ma to szczególne znaczenie teraz, gdy tryb szybki jest domyślny. Jeśli ktoś zauważy zbyt gwałtowny spadek dostępnych zasobów, ten wskaźnik daje mu natychmiastową podpowiedź co do potencjalnej przyczyny. Przejrzystość w zarządzaniu kosztami i wydajnością jest w przypadku takich narzędzi kluczowa.

Inne ulepszenia w pakiecie

Wydanie 0.111.0 to nie tylko zmiana trybu. Wprowadzono też inne istotne funkcjonalności.

Dynamiczny import lokalnych plików JavaScript w środowisku REPL (js_repl) to spore ułatwienie. Teraz można bezpośrednio importować lokalne pliki .js i .mjs, co ułatwia ponowne wykorzystanie skryptów z obszaru roboczego podczas interaktywnej pracy. To mały, ale praktyczny krok w stronę lepszej integracji.

Ulepszone wykrywanie pluginów to kolejna zmiana. Codex informuje teraz model o tym, które wtyczki są włączone na początku każdej sesji. Poprawia to wykrywanie zainstalowanych serwerów MCP (Model Context Protocol), aplikacji i umiejętności, pozwalając asystentowi od razu z nich skorzystać.

Nieoczekiwane skutki uboczne: skoki zużycia zasobów

Niestety, zmiany w wersji 0.111.0 nie przeszły bezproblemowo. Wśród użytkowników szybko pojawiły się zgłoszenia o gwałtownych skokach zużycia tokenów i zasobów planu po aktualizacji. Analiza problemu prowadzona na forach deweloperskich wskazuje na połączenie dwóch czynników.

Po pierwsze, samo włączenie domyślnego trybu Fast powoduje szybsze zużycie zasobów – było to oczekiwane, ale może zaskoczyć nieprzygotowanych użytkowników. Po drugie, co prawdopodobnie istotniejsze, w tej samej wersji wprowadzono zmiany w logice zdolności agentowych (agency).

Algorytmy odpowiedzialne za tworzenie agentów podrzędnych (subagents) stały się bardziej agresywne. Są one teraz jawnie zachęcane do równoległego uruchamiania wielu „eksplorerów” i ponownego ich wykorzystywania. W praktyce po aktualizacji sesje nadrzędne zaczęły tworzyć znacznie więcej długożyjących agentów podrzędnych, często z flagą fork_context: true.

Efekt? Jeden z raportów pokazuje, jak dzienne zużycie tokenów u jednego użytkownika skoczyło z poziomu około 100–180 milionów przed aktualizacją do ponad 1 miliarda w wersji 0.111.0. W niektóre dni nawet 86% wszystkich tokenów było zużywanych przez agentów podrzędnych, a nie przez główną sesję. To już nie tylko kwestia samego trybu Fast, ale zmiany w fundamentalnym zachowaniu systemu.

Co to oznacza dla programistów?

Zmiany w Codex 0.111.0 mają swoje dobre i złe strony. Z jednej strony domyślna szybkość i lepsza informacja w TUI to ewidentne ułatwienia. Praca staje się płynniejsza, a interfejs bardziej przejrzysty.

Z drugiej strony należy zachować teraz szczególną czujność. Korzystając z zaawansowanych funkcji, zwłaszcza tych związanych z wieloma agentami, można nieoczekiwanie narazić się na bardzo wysokie zużycie zasobów. Warto regularnie sprawdzać wskaźnik w nagłówku TUI. Należy też pamiętać, że tryb można zmienić – jeśli priorytetem jest oszczędność zasobów, a nie maksymalna prędkość, powrót do ustawienia Standard będzie rozsądnym krokiem.

Problem ze skokami zużycia został zgłoszony jako regresja i jest badany przez zespół deweloperski. To naturalna część cyklu rozwoju złożonego oprogramowania. Kluczowe jest jednak, aby użytkownicy byli świadomi tej dynamiki.

Wnioski

Aktualizacja Codex do wersji 0.111.0 pokazuje klasyczny dylemat rozwoju zaawansowanych narzędzi AI: balans między wydajnością, funkcjonalnością a przewidywalnością kosztów. Włączenie trybu Fast domyślnie to wyraźny sygnał, że twórcy stawiają na szybkość działania, prawdopodobnie odpowiadając na feedback społeczności.

Jednak równoległa zmiana w logice agentów podrzędnych, choć mająca na celu poprawę możliwości systemu, wprowadziła istotny efekt uboczny. Przypomina to, że takie systemy są niezwykle złożone, a pozornie odrębne modyfikacje mogą na siebie nieoczekiwanie oddziaływać.

Dla programisty korzystającego z Codex najważniejsza jest teraz świadomość: domyślnych ustawień, informacji widocznych w interfejsie oraz potencjalnego wpływu narzędzia na zużycie zasobów. Nowy wskaźnik w TUI jest w tej sytuacji bezcenny – pozwala trzymać rękę na pulsie i w porę zareagować, jeśli praca z asystentem stanie się zbyt kosztowna. Ostatecznie to od użytkownika zależy, jak wykorzysta potencjał szybszego trybu, zarządzając jednocześnie nowymi, bardziej złożonymi zachowaniami systemu.