Na początku 2026 roku OpenAI wprowadziło na rynek Frontier – platformę, która ma być odpowiedzią na problemy przedsiębiorstw z wdrażaniem sztucznej inteligencji do rzeczywistych procesów biznesowych. To nie jest kolejny interfejs API do modeli. Frontier ma być pełnoprawnym systemem operacyjnym dla agentów AI w firmach, pozwalającym budować i zarządzać „cyfrowymi współpracownikami”, którzy integrują się z infrastrukturą organizacji, taką jak hurtownie danych, systemy CRM czy wewnętrzne aplikacje.

Czym jest OpenAI Frontier i dla kogo powstał?

Głównym celem Frontier jest zamknięcie tzw. luki wdrożeniowej. Chociaż 75% pracowników przedsiębiorstw przyznaje, że AI umożliwia im realizację zadań, których wcześniej nie mogli wykonać, to przejście od eksperymentów do stabilnych, produkcyjnych systemów pozostaje wyzwaniem. Problemem nie jest już moc modeli, ale sposób, w jaki agenci są budowani i uruchamiani w skomplikowanym środowisku korporacyjnym.

Frontier adresuje te potrzeby, wyposażając agenty w to, czego potrzebują ludzie w pracy: wspólny kontekst biznesowy, onboarding, naukę przez praktykę z informacją zwrotną oraz jasne uprawnienia. Platforma jest skierowana do dużych organizacji, a wśród pierwszych użytkowników są już takie firmy jak HP, Intuit, Oracle, State Farm, Thermo Fisher czy Uber, a także BBVA, Cisco i T-Mobile.

Kluczowe możliwości platformy

Platforma Frontier opiera się na kilku filarach, które odróżniają ją od prostych frameworków dla agentów AI.

Autonomiczna, wieloagentowa egzekucja to serce platformy. Agenci mogą działać równolegle nad wieloetapowymi zadaniami, przekazywać je sobie nawzajem lub ludziom oraz używać narzędzi do planowania i działania w różnych systemach. Wszystko dostępne jest przez ujednolicone API, co znacząco przyspiesza wdrażanie rozwiązań.

Dostęp do modeli wielu dostawców i open source to kolejna ważna cecha. Choć Frontier daje priorytetowy dostęp do modeli OpenAI (w tym modeli klasy frontier, jak GPT-4), to obsługuje też agenty oparte na rozwiązaniach innych dostawców, takich jak Anthropic, Google czy Meta. Otwarta architektura ma zapobiegać uzależnieniu od jednego dostawcy (tzw. vendor lock-in).

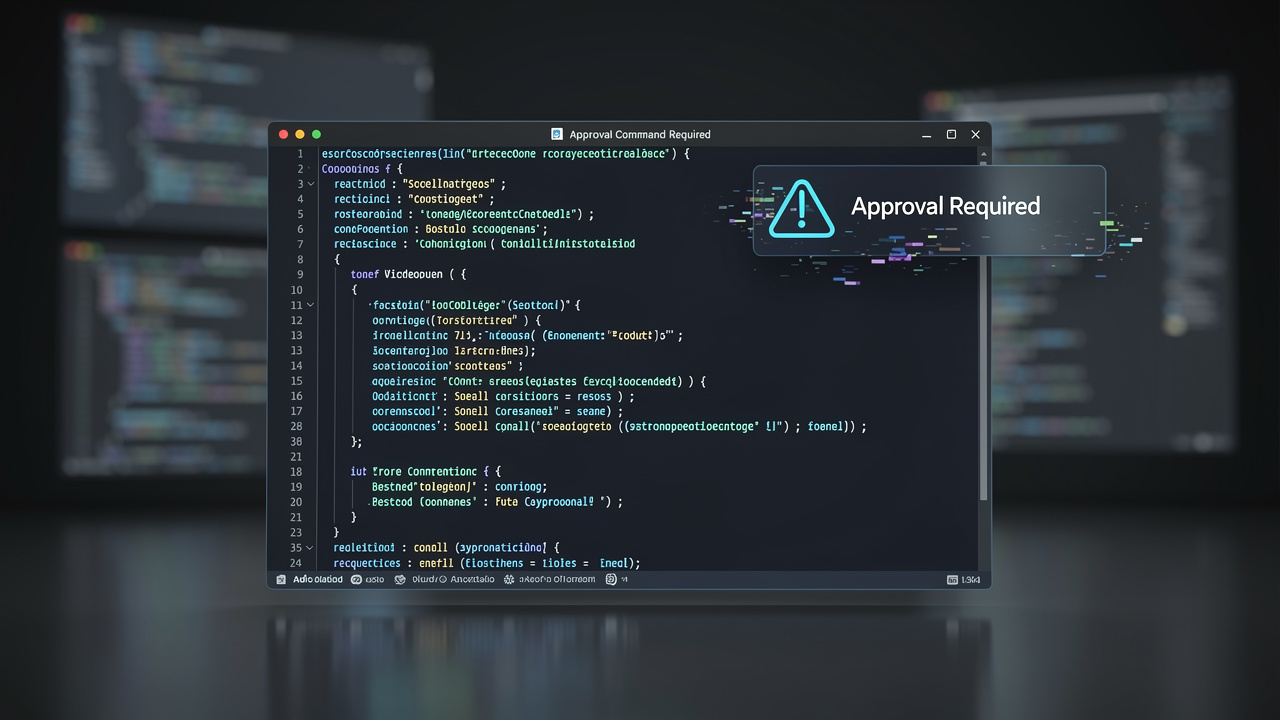

Bezpieczeństwo i zarządzanie (Governance) to prawdopodobnie największy atut Frontier w środowisku enterprise. Platforma wprowadza korporacyjny system zarządzania tożsamością (IAM), w którym każdy agent otrzymuje unikalną tożsamość z przypisanymi uprawnieniami. Wszystkie działania są rejestrowane w logach audytowych, a platforma oferuje mechanizmy kontroli zgodności (compliance).

Jak to działa w praktyce?

Wyobraźmy sobie proces obsługi klienta. Zamiast pojedynczego, odizolowanego chatbota, Frontier pozwala na stworzenie zespołu agentów. Jeden agent łączy się z CRM, by pobrać historię klienta. Drugi równolegle sprawdza dostępność produktu w systemie magazynowym. Trzeci analizuje wcześniejsze zgłoszenia w systemie ticketingowym. Wszyscy dzielą się kontekstem i mogą poprosić agenta-specjalistę od rozliczeń o wyjaśnienie złożonej kwestii finansowej, a na koniec – jeśli wartość transakcji przekroczy określony próg – zwrócić się o zatwierdzenie do pracownika. Cały ten złożony workflow jest koordynowany, monitorowany i zabezpieczony przez platformę.

OpenAI podaje konkretne przykłady skuteczności: w jednym z dużych koncernów produkcyjnych agenci skrócili czas optymalizacji produkcji z sześciu tygodni do jednego dnia. W globalnej firmie inwestycyjnej odciążyli handlowców, przejmując ponad 90% ich zadań administracyjnych.

Dostęp i przyszłość platformy

Obecnie dostęp do Frontier jest ograniczony. Platforma nie posiada publicznego cennika ani modelu samoobsługowego (self-service). OpenAI współpracuje z wczesnymi użytkownikami bezpośrednio przez dział sprzedaży oraz przez program Frontier Partners, który obejmuje wyspecjalizowanych dostawców rozwiązań AI, takich jak Abridge, Harvey i Sierra. Szersze udostępnienie platformy planowane jest w nadchodzących miesiącach.

Wprowadzenie Frontier przez OpenAI to wyraźny sygnał, że rynek enterprise AI wchodzi w nową fazę. Chodzi już nie tylko o potężniejsze modele, ale o kompleksowe platformy, które potrafią te modele bezpiecznie i skutecznie zintegrować z życiem organizacji. To krok w stronę świata, w którym agenci AI stają się rzeczywistymi, zarządzalnymi współpracownikami, a nie jedynie odizolowanymi narzędziami eksperymentalnymi.

Źródła

- Enterprise-grade AI agents with frontier and open-source model access. Ship faster with autonomous multi-agent execution through one API.

- Introducing OpenAI Frontier

- OpenAI Frontier Platform: Complete Guide to Enterprise AI Agent Deployment and Management (2026)

- OpenAI Frontier Guide: Enterprise AI Agent Platform for Building AI Coworkers (2026)