Google opublikowało kolejną znaczącą aktualizację swojej platformy programistycznej opartej na agentach – Antigravity. Najnowsza wersja skupia się głównie na poprawie bezpieczeństwa i użyteczności. To wyraźny krok w stronę stabilniejszego i pewniejszego środowiska do programowania ze wsparciem zaawansowanej sztucznej inteligencji.

Dwa najważniejsze elementy tej aktualizacji to rozszerzenie wsparcia dla mechanizmu sandboxingu w systemie Linux oraz ogólne ulepszenia platformy. To właśnie te zmiany mają największe znaczenie dla programistów pracujących w środowiskach DevOps i web developmentu z wykorzystaniem AI.

Sandboxing wkracza na Linuxa

Funkcja sandboxingu terminala to jedna z kluczowych innowacji w zakresie bezpieczeństwa. Pozwala ona na uruchamianie poleceń systemowych wydawanych przez agenty AI w izolowanym środowisku. Dla użytkowników macOS mechanizm ten, oparty na frameworku Seatbelt (sandbox-exec), był dostępny już wcześniej. Google rozszerza i utrwala tę ochronę dla użytkowników Linuxa.

Działa to w taki sposób, że polecenia wykonywane przez agenta są ograniczone do bieżącego folderu roboczego projektu. Agent nie ma swobodnego dostępu do całego systemu plików czy sieci. To istotna bariera, która zapobiega przypadkowym lub złośliwym modyfikacjom poza kontekstem projektu, nad którym aktualnie pracujesz. Funkcję tę można aktywować w ustawieniach użytkownika, przełączając opcję „Enable Terminal Sandboxing”. Choć na razie jest ona domyślnie wyłączona, zapowiedziano, że w przyszłych wersjach może stać się standardem.

Ogólne usprawnienia i poprawki

Aktualizacja wprowadza szereg ogólnych usprawnień i poprawek bezpieczeństwa, które mają na celu zwiększenie stabilności całej platformy. Wzmocnienie mechanizmów uwierzytelniania i komunikacji między komponentami bezpośrednio przekłada się na bezpieczeństwo całego środowiska programistycznego.

Poza tym Google stale pracuje nad uproszczeniem konfiguracji i zarządzania agentami, dostosowując platformę do powszechnych praktyk deweloperskich, co ułatwia kontrolę nad ich zachowaniem w projekcie.

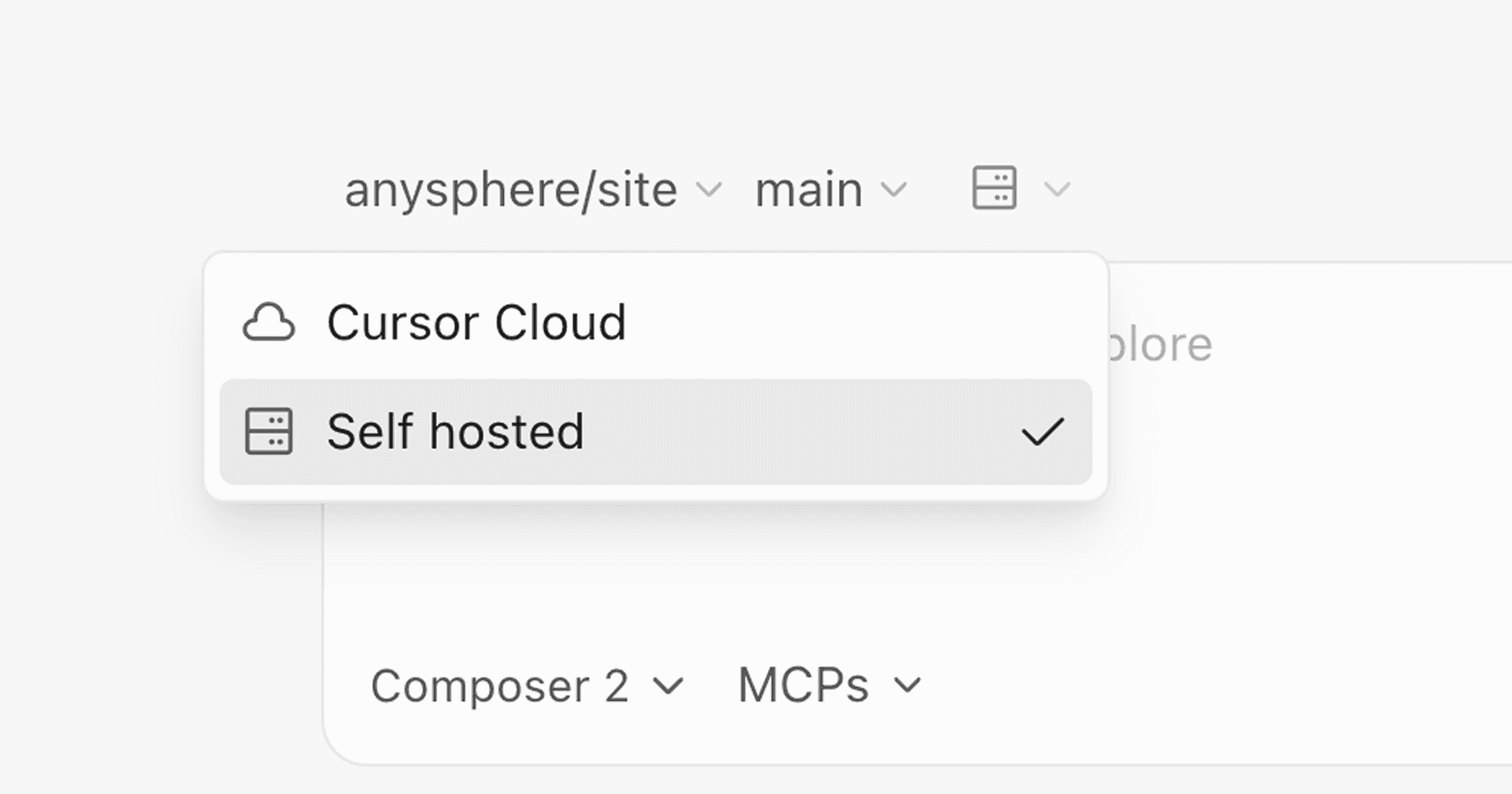

Aktualizacja to nie tylko bezpieczeństwo „pod maską”. Google wprowadza też szereg usprawnień interfejsu użytkownika, które mają uprzyjemnić codzienną pracę. Chat, czyli główny punkt komunikacji z agentem, został uproszczony i skondensowany. Teraz archiwizację całej rozmowy można wykonać jednym kliknięciem, co pomaga w utrzymaniu porządku.

Przebudowano również panel boczny (sidebar), a w samym menedżerze agentów pojawiły się liczne poprawki układu i UX. Te zmiany, choć mniej spektakularne niż sandboxing, przekładają się na odczuwalnie płynniejszą i bardziej intuicyjną obsługę.

Podsumowanie: platforma dla agentów dojrzewa

Najnowsze wydanie Google Antigravity jasno pokazuje kierunek rozwoju tego narzędzia. Google konsekwentnie przekształca swoje IDE w środowisko „agent-first”, gdzie sztuczna inteligencja jest równoprawnym uczestnikiem procesu tworzenia kodu. Kluczowe jest jednak, aby ta współpraca odbywała się w bezpiecznych ramach.

Wprowadzenie wsparcia dla sandboxingu na Linuxie to odpowiedź na realne potrzeby bezpieczeństwa w programowaniu z asystą AI. Ogólne usprawnienia zabezpieczeń i interfejsu idą w parze z dbałością o developer experience. Wszystko to sprawia, że Antigravity staje się coraz poważniejszym narzędziem dla programistów chcących w pełni wykorzystać potencjał agentów AI w projektach webowych i DevOps, nie rezygnując przy tym z kontroli nad własnym systemem.