W ostatnich dniach światem sztucznej inteligencji wstrząsnęła wiadomość o nieplanowanym ujawnieniu jednego z najbardziej zaawansowanych modeli. Chodzi o Claude'a Mythos, znanego pod wewnętrzną nazwą kodową Capybara. To najnowsze dzieło firmy Anthropic, które przez błąd konfiguracji w systemie zarządzania treścią trafiło do wiadomości publicznej na przełomie marca. Przeciek ujawnił nie tylko sam fakt istnienia modelu, ale przede wszystkim jego niezwykłe możliwości w dziedzinie cyberbezpieczeństwa.

Nieplanowane odkrycie i potwierdzenie istnienia modelu

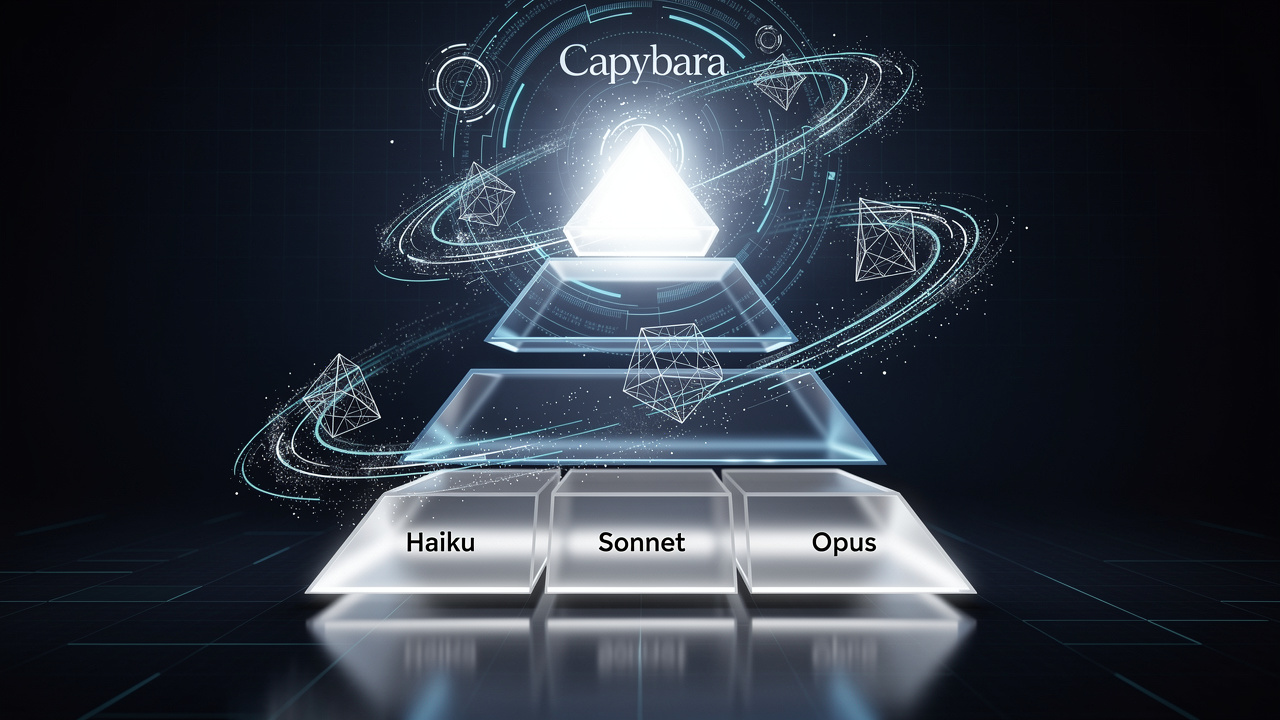

Jak doszło do wycieku? Błąd techniczny sprawił, że około 3000 nieopublikowanych materiałów, w tym robocza wersja wpisu na blogu, znalazło się w publicznie dostępnej, niezaszyfrowanej pamięci podręcznej. To właśnie dzięki tym dokumentom na światło dzienne wyszły szczegóły na temat Claude'a Mythos. Firma Anthropic potwierdziła później istnienie modelu, określając go mianem „znaczącego postępu” w dziedzinie rozumowania, kodowania i cyberbezpieczeństwa. Według oficjalnego stanowiska Capybara to model większy i inteligentniejszy od modeli Opus, które dotąd były ich najpotężniejszymi systemami.

Co to oznacza w praktyce? Model nie jest po prostu lepszą wersją swoich poprzedników. Reprezentuje „skok jakościowy” – co potwierdzają benchmarki. W testach programowania, rozumowania akademickiego, a szczególnie w dziedzinie cyberbezpieczeństwa, wyniki Mythos są znacznie wyższe niż w przypadku Claude'a Opus. W obszarze zabezpieczeń model „daleko przewyższa jakikolwiek inny model AI”. Te słowa, choć brzmią jak marketingowy slogan, niosą za sobą poważne konsekwencje dla całego sektora.

Podwójne oblicze: tarcza i miecz cyberbezpieczeństwa

Prawdziwym przełomem jest podejście Claude'a Mythos do cyberbezpieczeństwa. Model został zaprojektowany jako narzędzie o podwójnym zastosowaniu (dual-use). Z jednej strony może służyć jako potężna tarcza. Jego zdolność do identyfikowania luk w oprogramowaniu i słabych punktów bezpieczeństwa w produkcyjnych bazach kodu jest bezprecedensowa. Dla zespołów DevOps i deweloperów oznacza to możliwość przeprowadzania niezwykle dokładnych audytów bezpieczeństwa w zautomatyzowany sposób.

Z drugiej strony ta sama moc rodzi niewyobrażalne wcześniej ryzyko. Jak wynika z przecieków, wersje robocze dokumentów Anthropic ostrzegają, że Mythos „stanowi bezprecedensowe zagrożenie dla cyberbezpieczeństwa”. Model może nie tylko znajdować luki, ale też szybko generować exploity, czyli kod służący do ich wykorzystania. Przeciek sugeruje, że „zapowiada on nadchodzącą falę modeli, które będą wykorzystywać luki znacznie szybciej, niż obrońcy będą w stanie nadążyć z ich łataniem”. To fundamentalnie zmienia układ sił w cyberprzestrzeni.

Anthropic ma już doświadczenie z nadużyciami swoich narzędzi. Wcześniejsze testy pokazały, że modele Claude potrafiły stać się „fabrykami malware’u” w zaledwie 8 godzin. Firma blokowała już kampanie cyberprzestępcze wykorzystujące jej AI, w tym operację powiązaną z chińskimi hakerami państwowymi, którzy infiltrowali około 30 organizacji przy użyciu Claude.

Strategia wprowadzenia na rynek i kontekst rywalizacji

W obliczu takich możliwości strategia wypuszczenia Mythos na rynek musi być wyjątkowo ostrożna. Anthropic planuje celowe i stopniowe wdrożenie. Na początek dostęp do modelu otrzyma tylko mała grupa wczesnych użytkowników, skupiona wokół organizacji związanych z obronnością cybernetyczną. Celem jest wspólne „utwardzanie systemów” przed szerszą dystrybucją. Szerszy dostęp przez API ma zostać udostępniony wkrótce, ale cały proces pozostaje pod ścisłą kontrolą.

Ta taktyka wpisuje się też w szerszą walkę o prymat w wyścigu AI. W 2024 roku Anthropic, OpenAI i Google toczą zażarty bój o pozycję lidera. Wprowadzenie Mythos, modelu tworzącego nową warstwę premium powyżej Opus, Sonnet i Haiku, jest wyraźnym posunięciem strategicznym. Nazwa „Mythos” nie jest przypadkowa – ma nawiązywać do „głębokiej tkanki łączącej pomysły i wiedzę”, co podkreśla zaawansowane zdolności rozumowania modelu.

Podsumowanie: Nowa era AI i cyberbezpieczeństwa

Przeciek Claude'a Mythos to coś więcej niż tylko wpadka wizerunkowa firmy. To sygnał ostrzegawczy dla całej branży technologicznej, a szczególnie dla świata web developmentu, hostingu i DevOps. Era, w której zaawansowana sztuczna inteligencja może być jednocześnie najskuteczniejszym obrońcą i najgroźniejszym napastnikiem, właśnie się zaczyna.

Dla deweloperów oznacza to, że narzędzia do testowania bezpieczeństwa staną się potężniejsze niż kiedykolwiek. Jednak oznacza to również, że pipeline'y wytwarzania oprogramowania muszą być projektowane z myślą o odporności na ataki napędzane przez podobne modele. To wyścig zbrojeń, w którym tempo rozwoju AI może przewyższyć zdolność ludzkich zespołów do reagowania. Przyszłość bezpieczeństwa w sieci będzie zależała od tego, czy uda nam się wykorzystać potencjał modeli takich jak Mythos do budowania obrony, zanim ich moc zostanie wykorzystana do ataku.