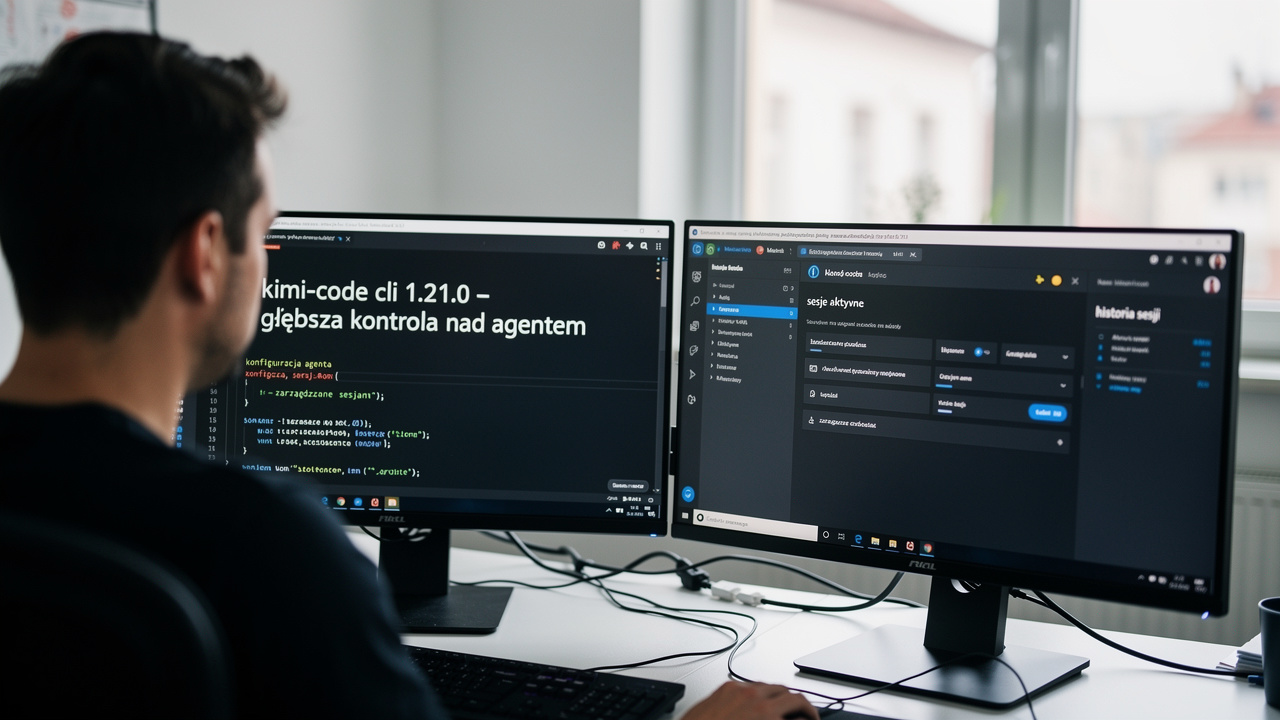

Wersja 1.21.0 narzędzia Kimi Code CLI przynosi zmiany, które wielu użytkowników nazywa przełomowymi. Nie chodzi tu o nowe, błyskotliwe funkcje, ale o solidną pracę nad fundamentami – sposobem, w jaki współpracujemy z asystentem AI w terminalu. To aktualizacja, która sprawia, że rozmowa z agentem przestaje być monologiem z przerwami na ładowanie, a zaczyna przypominać płynną, dynamiczną wymianę zdań z partnerem, który naprawdę słucha.

Głównym autorem wszystkich kluczowych zmian w tej wersji jest użytkownik GitHub o nicku @RealKai42, którego serie pull requestów znacząco przeprojektowały interakcję z agentem.

Sterowanie agentem w locie: koniec biernego oczekiwania

Najważniejsza nowość to inline running prompt. Wcześniej, gdy agent (np. model AI) rozpoczął generowanie odpowiedzi czy wykonywanie zadania, użytkownik musiał cierpliwie czekać na zakończenie całej tury. Każda chęć doprecyzowania, zmiany kierunku lub odpowiedzi na pytanie agenta wymagała przerwania procesu lub oczekiwania na jego koniec.

Wersja 1.21.0 burzy ten schemat. Teraz output agenta renderowany jest bezpośrednio w obszarze promptu, a użytkownik może w dowolnym momencie wpisać i wysłać kolejną wiadomość – tak zwaną komendę sterującą (steer). Może to być uzupełnienie instrukcji („zamiast tego użyj biblioteki X”), odpowiedź na pytanie agenta („tak, zatwierdzam usunięcie tego pliku”) lub całkowita zmiana kontekstu.

Co kluczowe, dzieje się to bez przerywania generowania bieżącej odpowiedzi. Agent otrzymuje nasz nowy input i dynamicznie dostosowuje do niego swoje dalsze działanie. Mechanizm został przeprojektowany – zamiast sztucznych, „syntetycznych” wywołań narzędzi, nasze komunikaty sterujące są teraz dołączane jako zwykłe wiadomości użytkownika. To rozwiązanie eleganckie i bardziej kompatybilne z systemem wizualizacji oraz zapisywaniem kontekstu.

W praktyce oznacza to, że jeśli agent zaczyna iść w niepożądanym kierunku, nie musimy już czekać, aż skończy, by to skorygować. Możemy od razu interweniować. To kolosalna różnica dla płynności pracy.

Trwałe prompty systemowe i lepszy kontekst

Kolejna istotna poprawka dotyczy zarządzania kontekstem sesji. Do tej pory prompt systemowy – czyli początkowe instrukcje definiujące rolę i sposób działania agenta – był traktowany jako coś ulotnego. Po restarcie sesji czy podczas jej analizy w narzędziach wizualizacyjnych ta kluczowa informacja mogła zostać utracona lub stać się nieczytelna.

W 1.21.0 prompt systemowy jest na stałe zapisywany jako pierwszy wpis w pliku context.jsonl. Ma to dwie ogromne zalety. Po pierwsze, narzędzia do wizualizacji sesji (jak kimi vis) mogą teraz odczytać pełny kontekst konwersacji, łącznie z pierwotnymi założeniami. Po drugie, gdy sesja jest wznawiana, agent odzyskuje dokładnie te same początkowe instrukcje, zamiast próbować je odtwarzać lub działać bez nich. Zapewnia to znacznie większą spójność i przewidywalność działań agenta w dłuższym horyzoncie czasowym.

Wizualizacja i zarządzanie sesjami bez wychodzenia z terminala

Panel wizualizacji (kimi vis) również otrzymał przydatne ulepszenia. Dodano skróty do katalogów sesji bezpośrednio ze strony podglądu sesji. Użytkownik może teraz jednym kliknięciem otworzyć folder bieżącej sesji w eksploratorze plików swojego systemu (obsługa zarówno macOS, jak i Windows) lub skopiować ścieżkę do schowka (akcja „Copy DIR”).

To może wydawać się drobnostką, ale dla deweloperów, którzy często analizują logi, ślady wykonania czy zapisane konteksty, jest to ogromne ułatwienie. Nie trzeba już ręcznie nawigować przez ukryte foldery w ~/.kimi/ – dostęp jest natychmiastowy.

Dopracowanie szczegółów: logowanie, powiadomienia i replay sesji

Reszta zmian w tej wersji to dopracowanie istniejących funkcji, które razem tworzą znacznie lepsze doświadczenie użytkownika (UX).

- Lepsze logowanie: Proces konfiguracji klucza API został usprawniony. Podczas weryfikacji klucza wyświetlany jest teraz animowany spinner, a w przypadku błędu (np. wybrania złej platformy) system wyświetla bardziej pomocne komunikaty. Po udanym logowaniu pojawia się jasne podsumowanie konfiguracji.

- Naprawione powiadomienia: Komenda aktualizacji wyświetlana w powiadomieniach typu „toast” jest teraz pobierana z jednej, stałej wartości, co eliminuje niespójności.

- Ulepszony replay sesji: Mechanizm odtwarzania zapisanych sesji został poprawiony, aby poprawnie wyświetlać komunikaty sterujące (steer messages) wysłane podczas pracy agenta. Filtruje też wewnętrzne, techniczne komunikaty systemowe, przez co odtworzona konwersacja jest czystsza i bardziej zrozumiała.

- Echo wpisanego tekstu: W trybie agenta, po wysłaniu wiadomości, prompt i nasz tekst są teraz wyświetlane (echo) w terminalu. Dzięki temu zapis rozmowy jest bardziej przejrzysty i przypomina naturalną wymianę zdań.

Kimi Code CLI: kontekst dla deweloperów

Dla tych, którzy nie mieli wcześniej styczności z tym narzędziem, warto przypomnieć, czym jest Kimi Code CLI. To open-source'owy agent AI działający w terminalu, stworzony przez MoonshotAI i wydany na licencji Apache 2.0. Jego filozofia opiera się na transparentności i kontroli – agent pomaga w zadaniach programistycznych (pisanie, edycja i analiza kodu, operacje shellowe, automatyzacja), ale cały jego proces myślowy, wywołania narzędzi i podjęte działania są widoczne dla użytkownika.

CLI obsługuje integrację z IDE przez Agent Client Protocol (ACP) – można je skonfigurować np. w edytorze Zed. Posiada też tryb shell, w którym można wykonywać zwykłe polecenia systemowe, oraz wsparcie dla MCP (Model Context Protocol), co pozwala na rozszerzanie jego możliwości o zewnętrzne narzędzia i serwisy.

Podsumowanie: ewolucja w kierunku płynnej współpracy

Wersja 1.21.0 Kimi Code CLI nie rzuca się w oczy nowym sloganem czy marketingowym szumem. To aktualizacja dla praktyków – deweloperów, którzy na co dzień używają AI jako partnera w terminalu. Główne zmiany – sterowanie agentem w locie, trwały kontekst i usprawnienia wizualizacji – mają jeden wspólny mianownik: zmniejszają dystans i opóźnienia między intencją użytkownika a działaniem agenta.

Dzięki temu praca z narzędziem staje się bardziej dynamiczna, interaktywna i w końcu przypomina prawdziwą współpracę, a nie asynchroniczne rzucanie zadań w próżnię. Te ulepszenia fundamentów są często ważniejsze niż kolejna nowa, choćby i spektakularna funkcja. Pokazują też dojrzałość projektu, który skupia się na jakości doświadczenia użytkownika, a nie tylko na rozbudowie listy możliwości.