Wydanie pre-release Gemini CLI, oznaczone jako v0.34.0-preview.4, przynosi ważne zmiany, które mogą znacząco poprawić doświadczenie użytkowników, szczególnie tych pracujących z AI w terminalu. To nie tylko kolejna iteracja – wprowadza eksperymentalne, ale kluczowe funkcje sandboxingu, solidne poprawki interfejsu oraz szereg poprawek stabilności, które wpływają na codzienną pracę. Jeśli używasz Gemini CLI do vibe codingu, automatyzacji DevOps czy szybkiego prototypowania, ta wersja jest warta uwagi.

Rewolucyjny sandboxing: LXC i gVisor

Jednym z najważniejszych, choć jeszcze eksperymentalnych elementów tej wersji, jest rozszerzenie możliwości sandboxingu. Sandbox, czyli izolowane środowisko wykonawcze, jest niezbędny do bezpiecznego testowania skryptów, uruchamiania nieznanych poleceń czy pracy z agentami AI, które mogą próbować wykonać niebezpieczne operacje.

Do tej pory Gemini CLI oferował pewne mechanizmy izolacji, ale v0.34.0-preview.4 idzie o krok dalej. Po pierwsze, dodano eksperymentalne wsparcie dla kontenerów LXC. LXC (Linux Containers) to lekki system konteneryzacji, który pozwala stworzyć izolowane środowisko Linuxa bez narzutu pełnej maszyny wirtualnej. Dla deweloperów oznacza to możliwość uruchamiania poleceń czy skryptów w bezpiecznej „klatce”, która chroni główny system.

Po drugie, pojawiła się integracja z gVisor (runsc). gVisor to sandbox runtime dla kontenerów, stworzony przez Google, który implementuje własny, minimalistyczny kernel w języku Go. Został zaprojektowany specjalnie do bezpiecznego izolowania aplikacji. Natywna integracja z gVisor w Gemini CLI daje jeszcze większą kontrolę i pewność podczas wykonywania operacji, które mogłyby potencjalnie naruszyć system.

Te dwie technologie nie są jeszcze domyślnie włączone i wymagają odpowiedniej konfiguracji, ale ich pojawienie się w kodzie źródłowym pokazuje wyraźny kierunek rozwoju: Gemini CLI chce być bezpiecznym narzędziem nie tylko do interakcji z AI, ale także do automatyzacji i DevOps. Szczególnie w przypadku vibe codingu – gdzie agent AI może dynamicznie generować i testować kod – takie sandboxy są absolutną koniecznością.

Szlifowanie interfejsu użytkownika

Drugim dużym obszarem zmian jest interfejs. W aplikacjach terminalowych UX często jest niedoceniany, ale w Gemini CLI otrzymuje on ciągłe poprawki.

Ciekawą nowością jest możliwość konfiguracji sandboxa w `settings.json`. Daje to większą kontrolę nad środowiskiem wykonawczym. Historia chatu została poprawiona, aby była bardziej przejrzysta i czytelna. Nawet generowane snapshoty SVG (używane np. do dzielenia się fragmentami pracy) otrzymały drobne, ale praktyczne ulepszenia.

Poprawki rdzenia i stabilność

Pod płaszczem nowych funkcji kryje się wiele poprawek stabilności, które bezpośrednio wpływają na niezawodność narzędzia.

W długo działających sesjach pojawiało się ryzyko crashów związanych z Out of Memory (OOM). W v0.34.0-preview.4 wprowadzono poprawki optymalizujące zarządzanie pamięcią, które mają temu zapobiegać.

Inne istotne bugfixy obejmują: autocomplete dla plików (poprawki dla ścieżek takich jak @scripts/copy_files.js, @file), refaktoryzację OAuth oraz zarządzanie extensions. Naprawiono także błąd AbortError w pętli strumieniowania (stream loop).

Drobne, ale znaczące ulepszenia

Warto wspomnieć o kilku innych zmianach, które składają się na lepszy user experience. Trackery zadań (task trackers) otrzymały zestaw narzędzi CRUD oraz poprawki wizualizacji, co pomaga w zarządzaniu zadaniami wewnątrz CLI. Agent przeglądarkowy został ulepszony poprzez emisję postępu, nakładkę (overlay) dla automatyzacji oraz dodatkowe testy integracyjne.

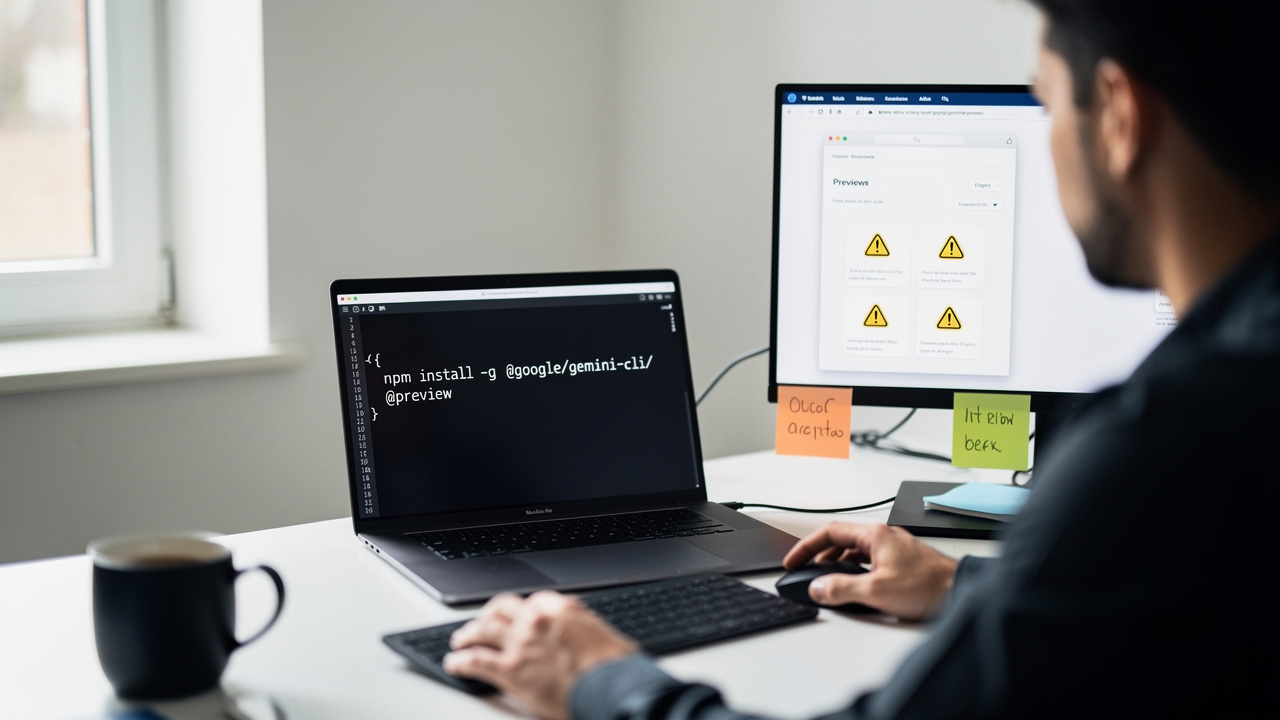

Jak zainstalować i co dalej

Wersja v0.34.0-preview.4, jak wszystkie wydania preview, nie jest jeszcze uważana za całkowicie stabilną. Może zawierać eksperymentalne funkcje, które będą jeszcze dopracowywane. Instalacja odbywa się standardowo poprzez npm:

npm install -g @google/gemini-cli@previewWarto zauważyć, że ta wersja jest częścią ciągłego cyklu rozwojowego Gemini CLI. Wcześniejsze nightly builds (jak v0.34.0-nightly.20260307) wprowadzały już różne zmiany. Wersja preview konsoliduje te usprawnienia i dodaje nowe.

Znaczenie dla deweloperów

Dla osób pracujących w obszarach web developmentu, AI, DevOps czy terminal-based workflows, ta wersja Gemini CLI przynosi konkretne korzyści. Sandboxing otwiera drogę do bezpiecznego testowania skryptów i automatyzacji generowanych przez AI. Poprawki UI sprawiają, że codzienna praca jest płynniejsza, a poprawki stabilności zmniejszają ryzyko utraty sesji czy problemów z autouzupełnianiem.

Choć niektóre funkcje są jeszcze eksperymentalne, ich obecność pokazuje, że Gemini CLI nie jest tylko „chatbotem w terminalu”. Staje się kompleksowym narzędziem dla deweloperów, którzy chcą integrować AI z codziennymi workflowami, zachowując bezpieczeństwo i kontrolę.

Podsumowanie

Gemini CLI v0.34.0-preview.4 to solidny krok naprzód dla tego terminalowego agenta AI. Eksperymentalne sandboxy (LXC i gVisor) odpowiadają na realne potrzeby bezpieczeństwa w vibe codingu i automatyzacji DevOps. Szlifowanie interfejsu i liczne poprawki rdzenia – od zarządzania pamięcią po autocomplete – zwiększają niezawodność aplikacji w długotrwałych sesjach.

To wydanie pokazuje, że projekt nie skupia się wyłącznie na nowych, spektakularnych funkcjach, ale także na fundamentach: stabilności, bezpieczeństwie i użyteczności. Dla deweloperów już korzystających z Gemini CLI aktualizacja do wersji preview może znacząco poprawić komfort pracy. Dla tych, którzy jeszcze go nie próbowali – to dobry moment, aby sprawdzić, jak terminalowe AI może być nie tylko potężne, ale także bezpieczne i przemyślane.