Pojawienie się modelu Kimi K2.5 od chińskiej firmy Moonshot AI wywołało spore zamieszanie w świecie sztucznej inteligencji. Ten model open source, dostępny od stycznia 2026 roku, w wielu syntetycznych testach pokonuje znacznie droższego i zamkniętego Claude'a Opus 4.5 od Anthropic. Szczególnie zaskakują jego wyniki w zadaniach agentycznych czy związanych z kodowaniem, zwłaszcza biorąc pod uwagę kolosalną różnicę w cenie.

Jednak prawdziwe życie projektowe weryfikuje te triumfy. Choć benchmarki wskazują na lidera, praktyczne doświadczenia programistów rysują bardziej zniuansowany obraz. To opowieść o tym, jak liczby z testów mogą mówić co innego niż codzienna praca z kodem.

Rewelacyjne Wyniki w Testach Syntetycznych

Kimi K2.5 naprawdę imponuje na papierze. W kluczowych obszarach, które są obecnie przedmiotem intensywnych badań, wypada lepiej od uznanego Claude'a Opus 4.5.

Przede wszystkim, model Moonshot AI błyszczy w zadaniach agentycznych, gdzie model musi samodzielnie planować i wykonywać złożone sekwencje akcji. Dzięki architekturze umożliwiającej równoległe działanie „rojów” agentów, Kimi osiąga nawet 4-4.5 razy szybszy czas wykonania w porównaniu do Clauda. W wewnętrznych benchmarkach Moonshot AI redukcja całkowitego czasu działania sięgała 80%.

Wygrał także w testach sprawdzających rozumienie treści przeglądarki (browser comprehension) i szerokiego wyszukiwania (wide search). Ma też wyraźną przewagę techniczną pod względem kontekstu: dysponuje oknem 256 tysięcy tokenów, podczas gdy Claude Opus 4.5 „tylko” 200 tysięcy. To różnica odpowiadająca około 80 stronom A4 tekstu, co może mieć znaczenie przy przetwarzaniu bardzo długich dokumentów.

Przewaga Ceny i Dostępności

Różnica w cenie jest tak duża, że aż trudno ją zignorować. Kimi K2.5 jest od 8 do 9 razy tańszy w uśrednionym koszcie użytkowania niż jego rywal z Anthropic. Gdy spojrzymy na szczegóły, przewaga jest jeszcze większa dla tokenów wyjściowych.

Claude Opus 4.5 kosztuje około 10.6 razy więcej za tokeny wejściowe i aż 12.5 razy więcej za tokeny wyjściowe. Dla firm czy developerów intensywnie korzystających z API, taka rozbieżność w cenach jest kluczowym argumentem ekonomicznym.

Dodatkowo, Kimi jest w pełni open source. Jego wagi są dostępne na platformie Hugging Face, co oznacza, że można go uruchomić na własnej infrastrukturze. To ogromny atut dla organizacji dbających o prywatność danych, które nie chcą lub nie mogą wysyłać informacji do zewnętrznych API. Daje też społeczności wolność do modyfikacji, eksperymentów i dostosowania modelu do specyficznych potrzeb.

Praktyka Weryfikuje Teorię: Testy Prawdziwego Kodowania

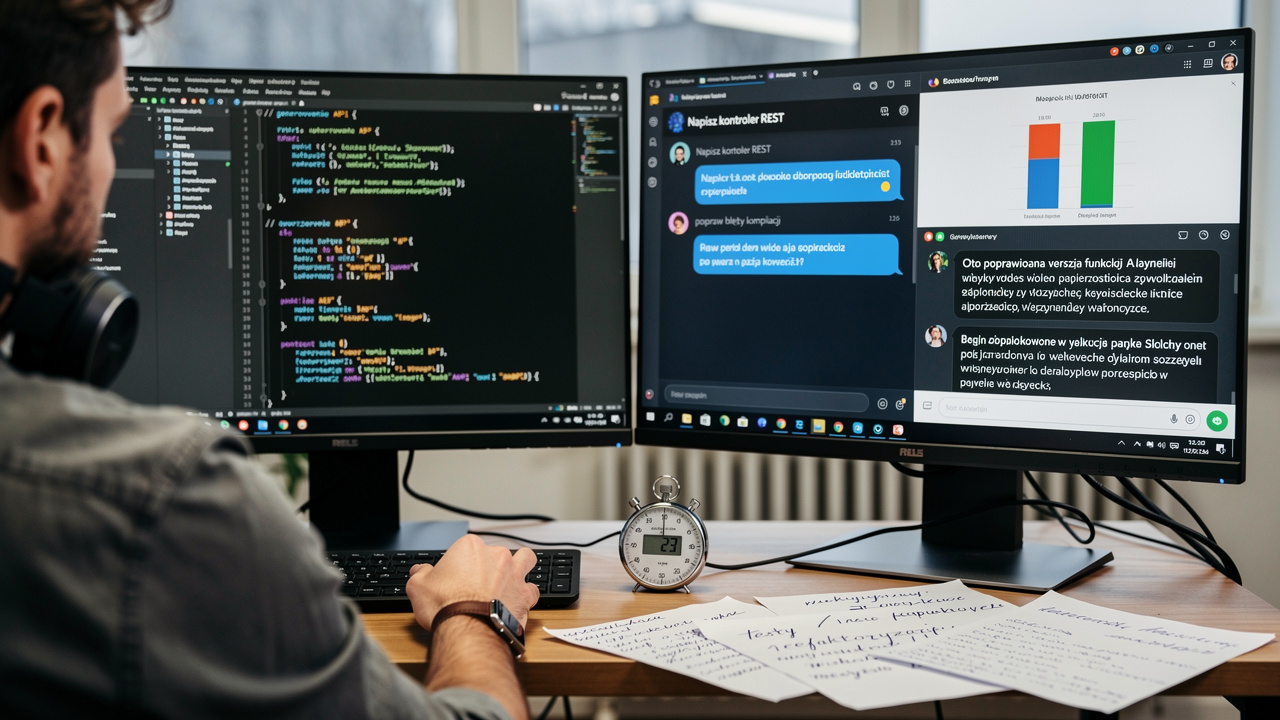

Benchmarki to jednak nie wszystko. Gdy przyszło do praktycznego zastosowania w realnym projekcie programistycznym, obraz się skomplikował. Jeden z developerów przeprowadził dogłębny test, próbując zbudować aplikację przy pomocy obu asystentów.

Kimi K2.5 potrzebował około 23 minut na stworzenie pierwszej wersji kodu i kolejnych prawie 10 minut na wprowadzenie poprawek. Efektem było zmodyfikowanie 22 plików z ponad 3 tysiącami linijek dodanego kodu. Choć brzmi to imponująco, proces nie był pozbawiony problemów.

Claude Opus 4.5, choć może wolniejszy w niektórych syntetycznych testach agentycznych, w tym praktycznym zadaniu okazał się sprawniejszy end-to-end. Praca z nim była po prostu mniej targana błędami i nieporozumieniami. Autor testu podsumował to jasno: mimo niższej ceny i lepszych wyników Kimi w benchmarkach, do realnej pracy nad oprogramowaniem wciąż woli Clauda.

Dlaczego tak się dzieje? Część obserwatorów rynku wskazuje na różnice kulturowe w podejściu do rozwoju AI. Chińskie modele, takie jak Kimi, są często bardzo agresywnie optymalizowane pod kątem popularnych zestawów benchmarków. Firma Anthropic zdaje się bardziej skupiać na płynności, niezawodności i jakości doświadczenia użytkownika w codziennych, nieoczywistych zadaniach.

Dla Kogo Jest Kimi K2.5, a Dla Kogo Claude Opus 4.5?

Wybór między tymi modelami nie jest więc zero-jedynkowy i zależy od konkretnych potrzeb.

Kimi K2.5 świetnie się sprawdzi, gdy:

Koszt jest krytycznym czynnikem. Przy 8-12x niższych opłatach, eksperymentowanie lub skalowanie użycia jest znacznie tańsze.

Prywatność danych jest absolutnym priorytetem. Możliwość hostowania na własnych serwerach to decydujący argument.

Potrzebujesz maksymalnie długiego kontekstu. Dodatkowe 56k tokenów może przesądzić o sukcesie przy analizie ogromnych dokumentów.

Wykonujesz powtarzalne, zdefiniowane zadania agentyczne, gdzie jego równoległa architektura może błysnąć pełną mocą.

Claude Opus 4.5 pozostaje liderem, gdy:

Liczy się płynność i jakość w nieprzewidywalnej, twórczej pracy. Szczególnie w programowaniu, gdzie zrozumienie kontekstu i intencji jest kluczowe.

Potrzebujesz modelu „do wszystkiego” do złożonych zadań badawczych, pisania lub analizy, gdzie mierzalne benchmarki nie oddają pełni jego możliwości.

Jesteś gotów zapłacić premię za produkt dopracowany pod kątem użytkownika i wspierany przez silną, zachodnią firmę.

Podsumowanie

Bitwa między Kimi K2.5 a Claude'em Opus 4.5 doskonale ilustruje obecny etap wyścigu w AI. Z jednej strony mamy potężny, otwarty model, który za ułamek ceny bije liderów w standaryzowanych testach. To sygnał, że era wyłącznej dominacji wielkich, zamkniętych modeli dobiega końca, a dostępność i przystępność cenowa stają się równie ważne.

Z drugiej strony, doświadczenie pokazuje, że wygrywanie benchmarków nie przekłada się automatycznie na bezwzględną wyższość w każdej rzeczywistej aplikacji. Claude Opus 4.5 przypomina, że subiektywna jakość, rozumienie niuansów i niezawodność wciąż mają ogromną wartość, za którą wielu jest w stanie zapłacić.

Ostatecznie to świetla wiadomość dla użytkowników końcowych i developerów. Presja ze strony tanich, open source'owych modeli jak Kimi zmusza gigantów do innowacji i może prowadzić do obniżek cen. Jednocześnie rynek się różnicuje. Nie musimy już szukać jednego, uniwersalnego „najlepszego” modelu. Możemy wybierać narzędzie idealnie dopasowane do budżetu, wymagań technicznych i konkretnego zadania, które mamy do wykonania.