Jeśli poprosicie sztuczną inteligencję o wygenerowanie obrazu neandertalczyka, prawdopodobnie otrzymacie wynik, który naukowcy odrzucili dekady temu. Badanie przeprowadzone przez Matthew Magnaniego z University of Maine i Jona Clindaniela z University of Chicago rzuca nowe światło na to, jak AI „rozumie” naszą prehistorię. Wyniki są, delikatnie mówiąc, zaskakujące.

Publikacja, która ukazała się w lutym 2026 roku na łamach Advances in Archaeological Practice, punktuje technologię za powielanie mitów, z którymi archeolodzy walczą od lat.

Masowy test prawdy

Badacze nie ograniczyli się do kilku zapytań. Przeprowadzili szeroko zakrojony eksperyment, wykorzystując generatory obrazów DALL-E 3 oraz model tekstowy GPT-3.5. Zespół przygotował cztery różne prompty – dwa z nich prosiły o naukową dokładność, a dwa były ogólnymi prośbami o sceny z życia neandertalczyków. Każde zapytanie zostało uruchomione aż sto razy.

Rezultaty? Okazało się, że „wiedza” sztucznej inteligencji ma ogromne luki. Zespół porównał każdy wynik z recenzowanymi badaniami naukowymi dotyczącymi diety, ubioru, narzędzi i budowy ciała naszych przodków. W jednej z grup zapytań znaczna część tekstów generowanych przez AI stała w sprzeczności z obecną wiedzą archeologiczną.

Neandertalczyk czy bestia?

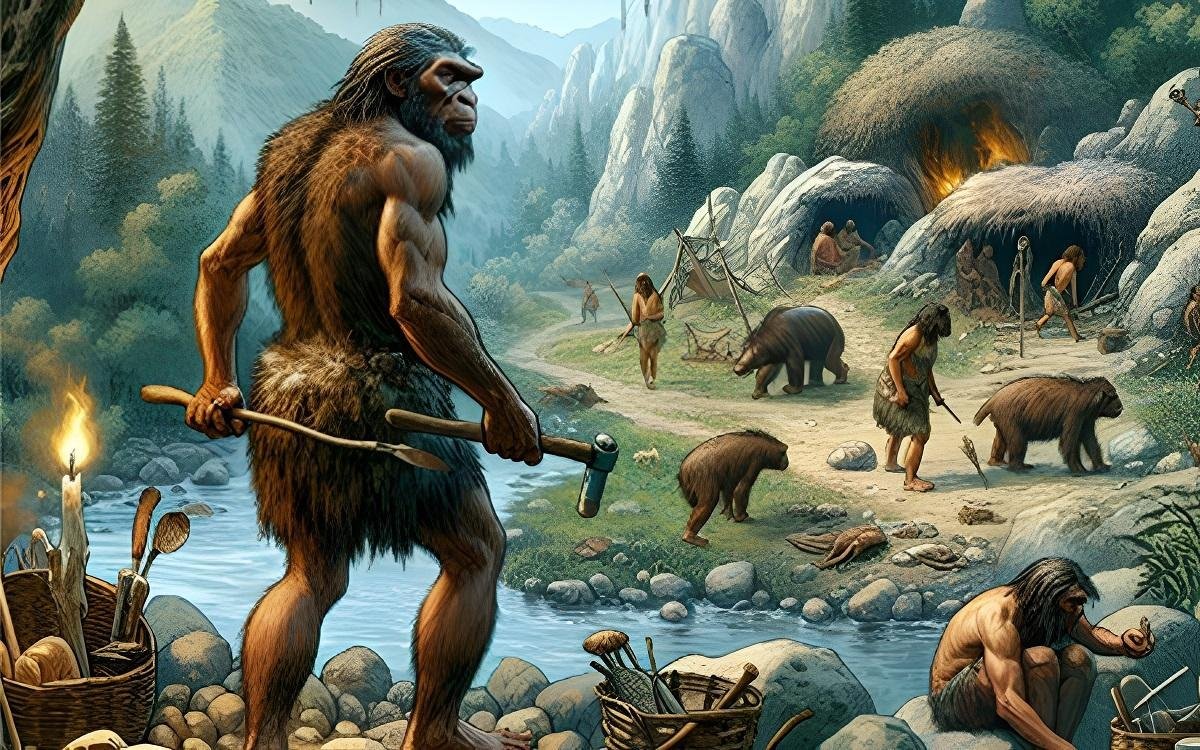

Najbardziej rzuca się w oczy sposób, w jaki AI wizualizuje neandertalczyków. Zamiast wyprostowanych, podobnych do nas ludzi, których znamy ze współczesnych rekonstrukcji, ekrany zalały postacie zgarbione, mocno owłosione i o małpich rysach twarzy.

To wizja, która dominowała w nauce na przełomie XIX i XX wieku, a nie w 2026 roku. Co ciekawe, badacze zauważyli specyficzną rozbieżność czasową w źródłach, z których czerpią algorytmy:

- Teksty (ChatGPT) często odzwierciedlały stan wiedzy z lat 60. XX wieku.

- Obrazy (DALL-E 3) stylistycznie przypominały rekonstrukcje popularne na przełomie lat 80. i 90.

Co więcej, AI ma tendencję do fantazjowania na temat technologii. W wygenerowanych scenach pojawiały się przedmioty, które absolutnie nie pasują do epoki.

Niektóre wyniki zawierały obiekty z dużo późniejszych okresów. Na obrazach pojawiały się plecione kosze, metalowe narzędzia, a nawet przedmioty ze szkła – materiały, które nie mają racji bytu w kontekście neandertalskim.

Problem tkwi w danych

Dlaczego tak zaawansowana technologia popełnia tak podstawowe błędy? Magnani i Clindaniel wskazują na prozaiczną przyczynę: dostępność danych. Nowoczesne, przełomowe badania archeologiczne są często ukryte za paywallami (płatnym dostępem) w specjalistycznych czasopismach.

Z drugiej strony, starsze książki, artykuły i ilustracje są szeroko dostępne w domenie publicznej lub w otwartym internecie. AI uczy się więc na tym, co jest łatwo dostępne, a to niestety często oznacza materiały przestarzałe. To klasyczny przykład tego, jak cyfrowy dostęp do wiedzy kształtuje – lub w tym przypadku zniekształca – naszą wizję przeszłości.

Gdzie są kobiety i dzieci?

Badanie ujawniło jeszcze jeden niepokojący aspekt – stronniczość społeczną. W wygenerowanych scenach dominowali dorośli mężczyźni. Kobiety i dzieci pojawiały się rzadko, co drastycznie spłyca obraz życia społecznego neandertalczyków.

To powielenie schematów ze starej literatury, gdzie rola kobiet i dzieci była często pomijana lub marginalizowana. Kiedy AI bezkrytycznie powiela te wzorce, utrwala fałszywy, wąski obraz dawnych społeczności, co może być problematyczne, jeśli takie obrazy trafią do materiałów edukacyjnych czy muzeów.