Co by się stało, gdyby twój asystent AI nie czekał na twoje polecenie, ale sam inicjował działania, gdy w projekcie pojawi się problem, lub regularnie wykonywał nudne, powtarzalne zadania? Ta wizja właśnie staje się rzeczywistością. Twórcy Cursor – popularnego środowiska programistycznego napędzanego sztuczną inteligencją – ogłosili właśnie wprowadzenie funkcji Automatyzacji. To nowy mechanizm pozwalający budować always-on agents, czyli inteligentne agenty działające non-stop, wyzwalane harmonogramem lub zdarzeniami z zewnętrznych systemów.

Ta aktualizacja to nie tylko kolejna funkcja, ale potencjalnie znacząca zmiana w sposobie, w jaki zespoły zarządzają kodem, incydentami i rutyną deweloperską. W tym samym czasie Cursor ogłosił również dostępność w środowiskach JetBrains, co pokazuje strategię dotarcia do jak najszerszego grona programistów.

Automatyzacje: Agenci, Którzy Nigdy Nie Śpią

Podstawowa idea Automatyzacji jest prosta: zamiast ręcznie uruchamiać agenta AI za każdym razem, gdy potrzebujesz przeglądu kodu, analizy błędu czy podsumowania aktywności, możesz go skonfigurować tak, by działał samoczynnie. Agenci ci działają w chmurze, w odizolowanym środowisku (sandboxie), co gwarantuje bezpieczeństwo i powtarzalność.

– Wyzwalacze (*Triggers*) są sercem systemu. Można ustawić agenta na działanie według harmonogramu – na przykład jak zadanie cron, które wykonuje się co noc, analizując test coverage. Drugi rodzaj to reakcja na zdarzenia z integrowanych platform. Agent może się obudzić, gdy:

* W Slacku pojawi się nowa wiadomość w określonym kanale.

* W Linear lub Jirze stworzony zostanie nowy issue.

* Na GitHubie zostanie otwarty lub zmergowany pull request.

* W PagerDuty wyzwolony zostanie incydent.

* Aplikacja otrzyma własny, niestandardowy webhook.

– Wykonanie następuje w chmurze Cursor. Agent dostaje instrukcje od użytkownika (np. „Przeanalizuj złożony PR i oceń ryzyko”) oraz dostęp do narzędzi przez Model Context Protocol (MCP). Może więc korzystać z zewnętrznych narzędzi do sprawdzania logów, zapisu wyników czy z API GitHub do komentowania.

– Pamięć (*Memory*) to kluczowy komponent, który odróżnia tę funkcję od prostych skryptów. Agenci mają dostęp do narzędzia pamięci, które pozwala im uczyć się na podstawie poprzednich uruchomień. To oznacza, że z każdym kolejnym wykonaniem zadania mogą działać lepiej, precyzyjniej i bardziej dostosowując się do kontekstu projektu.

Jak tłumaczą twórcy w materiałach wideo: „Ponieważ agenci stali się naprawdę zdolni do samodzielnego wykonywania pracy, często uruchamialiśmy ich w kółko do tych samych typów zadań. Pomyśleliśmy więc: dlaczego tego nie zautomatyzować?”.

Praktyczne Zastosowania: Od Codeownerów Do Incydentów

Teoretyczna możliwość to jedno, ale prawdziwą wartość widać w konkretnych przypadkach użycia. Cursor w materiałach promocyjnych i na forach wskazuje kilka gotowych schematów.

- Agentyczny Codeowner*. To chyba najczęściej przywoływany przykład. Konfigurujesz agenta, który jest wyzwalany za każdym razem, gdy na repozytorium zostanie otwarty nowy pull request lub dokonany push. Jego zadaniem jest automatyczna ocena ryzyka tego PR. Agent analizuje:

- Blast radius: Jak szeroki wpływ mają zmiany? Czy dotyczą kluczowych modułów?

Złożoność kodu. Wpływ na infrastrukturę (np. zmiany w konfiguracji, bazie danych).

Na podstawie tej analizy agent może podjąć autonomiczne decyzje: dla PR-ów o niskim ryzyku – automatycznie je zaakceptować; dla tych o wysokim ryzyku – oznaczyć odpowiednich recenzentów i powiadomić zespół przez Slacka. Cały proces jest logowany dla przejrzystości.

Reakcja na Incydenty*. To bezpośrednia odpowiedź na koszmar każdego dewelopera – budzik o trzeciej nad ranem z powodu awarii. Agent zintegrowany z systemami monitoringu może zostać wyzwolony w momencie zgłoszenia incydentu. Jego pierwszym zadaniem jest szybka diagnostyka: sprawdzenie logów, przeszukanie ostatnich commitów pod kątem potencjalnie problematycznych zmian. Następnie, w oparciu o znalezione informacje, może od razu zaproponować hotfix w osobnym branchu, stworzyć zadanie naprawcze w trackerze lub wysłać streszczoną diagnozę do kanału Slack dla zespołu. Twórcy twierdzą, że tego typu automatyzacja znacząco redukuje czas reakcji.

Rutynowa Konserwacja i Analiza*. Tu automatyzacje odciążają zespół z żmudnych, ale ważnych zadań:

Cotygodniowe podsumowania: Agent uruchamiany w każdy piątek wieczorem skanuje kod, commity i PR-y z ostatniego tygodnia, generując zwięzłe podsumowanie postępu i potencjalnych problemów.

Wyszukiwanie martwego kodu: Regularne skanowanie projektu w poszukiwaniu nieużywanych funkcji, zmiennych lub importów.

Triadaż błędów: Automatyczne sprawdzanie nowo zgłoszonych błędów pod kątem duplikatów, zbieranie dodatkowych informacji i tworzenie dobrze opisanych zadań w trackerze.

Co ciekawe, wczesni użytkownicy wykorzystują te agenty do zadań wykraczających poza czysty kod. Automatyzacje agregują notatki z spotkań, punkty akcji, PR-y i dyskusje ze Slacka w ujednolicone dashboards. Potrafią też generować zadania w trackerach bezpośrednio z wątków na Slacku, przekształcając luźną dyskusję w śledzone tickety.

Jak To Działa Od Kuchni i Dla Kogo Jest Przeznaczone

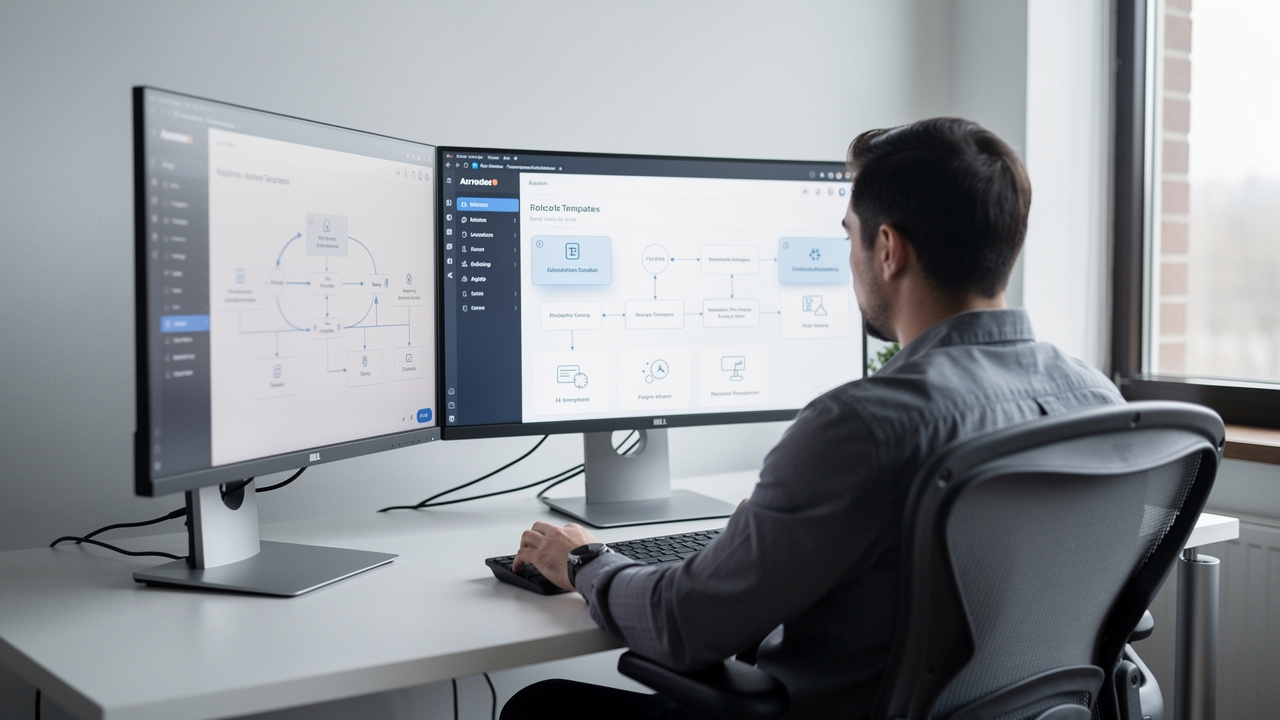

Rozpoczęcie pracy z Automatyzacjami wydaje się celowo uproszczone. Twórcy zachęcają, by zacząć od gotowego szablonu. Nie ma potrzeby konfigurowania oddzielnego środowiska chmurowego – agenci działają w tej samej infrastrukturze co Cloud Agents Cursor i pracują na sklonowanych repozytoriach użytkownika.

W kwestii modeli AI, użytkownik ma wybór. Cursor testował różne frontier models (najnowocześniejsze modele od głównych dostawców) pod kątem wydajności w tych zadaniach.

Warto podkreślić, że funkcja wspiera GitHub, co jest kluczowe dla adopcji w organizacjach. Na forum użytkownicy wyrażają już życzenie, by w przyszłości agenci mogli działać jeszcze bardziej autonomicznie, np. korzystając z funkcji Computer Use (bezpośredniej interakcji z systemem) czy przeglądarki.

Cursor Wkracza Do Świata JetBrains

Niemal równolegle z premierą Automatyzacji, Cursor ogłosił dostępność w popularnych środowiskach JetBrains, takich jak IntelliJ IDEA, PyCharm czy WebStorm. To ważny ruch strategiczny.

Dostęp ten jest realizowany przez Agent Client Protocol (ACP), który działa jak most między IDE a chmurą Cursor. Deweloperzy przyzwyczajeni do mocnych narzędzi JetBrains dla Javy, Pythona czy JavaScriptu nie muszą zmieniać środowiska, by korzystać z zaawansowanych modeli AI od Open AI, Anthropic, Google czy samego Cursor do agent-driven development. Wystarczy zainstalować plugin ACP z rejestru w IDE i zalogować się na istniejące konto Cursor. To poszerza znacznie potencjalną bazę użytkowników zaawansowanych funkcji agentowych. Ogłoszenie tej integracji miało miejsce 5 marca 2026 roku.

Podsumowanie: W Kierunku Autonomicznej Fabryki Oprogramowania

Wprowadzenie Automatyzacji przez Cursor nie jest izolowanym ulepszeniem. To część szerszego trendu i odpowiedź na wyraźną dysproporcję. Sztuczna inteligencja w ciągu ostatnich lat dramatycznie przyspieszyła etap produkcji kodu. Pisanie nowych funkcji, prototypowanie, nawet tłumaczenie między językami – to wszystko stało się szybsze.

Jednak etapy przeglądu, monitorowania i konserwacji wciąż często spoczywały głównie na ludziach, tworząc wąskie gardło. Automatyzacje wydają się być bezpośrednim narzędziem do zniwelowania tej luki. Pozwalają stworzyć wielozadaniową, działającą 24/7 „pomocniczą załogę” AI, która przejmuje część tej odpowiedzialności.

Funkcja ta, w połączeniu z dostępnością w JetBrains, umacnia pozycję Cursor nie tylko jako zaawansowanego edytora, ale jako platformę do autonomicznego rozwoju oprogramowania. To krok w stronę wizji pełnej „fabryki software’owej”, gdzie inteligentne agenci koordynują się z ludzkimi zespołami, zajmując się przewidywalną rutyną, szybką reakcją i ciągłą analizą, podczas gdy ludzie skupiają się na złożonych problemach, architekturze i kreatywnych aspektach tworzenia.